Python'da Scrapy (Geliştiriciler İçin Nasıl Çalışır)

Çevrimiçi veri toplama ve belge oluşturma alanlarında etkinlik ve verimlilik kritiktir. Web sitelerinden veri çıkarımı ve ardından profesyonel seviyede belgelere dönüştürülmesi için güçlü araçlar ve çerçevelerin sorunsuz entegrasyonu gereklidir.

İşte Scrapy, Python'da bir web kazıma çerçevesi ve IronPDF, çevrimiçi veri çıkarmayı optimize etmek ve dinamik PDF'ler oluşturmak için birlikte çalışan iki güçlü kutuphane.

Python'da, en iyi web tarama ve kazıma kutuphanesi olan Scrapy sayesinde geliştiriciler, karmaşık ağı kolayca gezebilir ve hassasiyet ve hızla hızlı bir şekilde yapılandırılmış veri çıkarabilir. Sağlam XPath ve CSS seçicileri ve eşzamanlı olmayan mimarisi ile her türlü karmaşık veri kazıma işleri için ideal seçenektir.

IronPDF ise, PDF belgelerinin programatik bir şekilde oluşturulması, düzenlenmesi ve işlenmesini destekleyen güçlü bir .NET kutuphanesidir. IronPDF, güçlü PDF oluşturma araçlarıyla geliştiricilere dinamik ve estetik açıdan hoş PDF belgeleri oluşturmak için eksiksiz bir çözüm sunar, HTML'den PDF'ye dönüştürme ve PDF düzenleme yetenekleri de dahil.

Bu yazı, Scrapy Python ile IronPDF'nin sorunsuz entegrasyonuna sizi götürecek ve bu dinamik çiftin web kazıma ve belge oluşturmanın nasıl değiştiğini gösterecek. Scrapy ile webden veri kazımaktan, IronPDF ile dinamik olarak PDF raporları oluşturmaya kadar bu iki kutuphanenin karmaşık işleri kolaylaştırmak ve geliştirme iş akışlarını hızlandırmak için nasıl birlikte çalıştığını göstereceğiz.

IronPDF'yi kullanarak Scrapy'nin tüm potansiyelini ortaya çıkarırken web kazıma ve belge oluşturmadaki olasılıkları keşfedin.

Eşzamanlı Olmayan Mimari

Scrapy'nin kullandığı eşzamanlı olmayan mimari, birden fazla isteği aynı anda işlemesini sağlar. Bu da, karmaşık web siteleri veya büyük miktarda veri ile çalışırken artan verimliliğe ve daha hızlı web kazıma hızlarına yol açar.

Sağlam Tarama Yönetimi

Scrapy, otomatik URL filtreleme, ayarlanabilir istek zamanlaması ve entegre robots.txt yönerge işleme gibi güçlü tarama süreç yönetim özelliklerine sahiptir. Geliştiriciler, tarama davranışını kendi ihtiyaçlarına uydurmak ve web sitesi kılavuzlarına uyumu garanti etmek için ayarlamalar yapabilir.

XPath ve CSS Seçicileri

Scrapy, kullanıcıların HTML sayfalarında öğeleri seçmek ve gezinmek için XPath ve CSS seçicileri kullanmasına olanak tanır. Bu esneklik, geliştiricilerin bir web sayfasındaki belirli unsurlar veya desenleri hassas bir şekilde hedef almasına olanak tanır ve veri çıkarımını daha doğru ve güvenilir hale getirir.

Öğe Yolu

Geliştiriciler, scrape edilen verileri ihraç etmeden veya depolamadan önce işlemeye yönelik yeniden kullanılabilir bileşenler belirtmek için Scrapy'nin öğe yolunu kullanabilir. Temizleme, doğrulama, dönüşüm ve yinelenen verilerin birleştirilmesi gibi işlemler gerçekleştirerek çıkartılan verinin doğruluğunu ve tutarlılığını garanti eder.

Yerleşik Ara Katmanı

Scrapy'de önceden yüklenmiş bir dizi ara katman bileşeni, otomatik çerez işleme, istek kısma, kullanıcı temsilcisi döndürme ve proxy döndürme gibi özellikler sunar. Bu ara katman öğeleri, kazıma verimliliğini artırmak ve yaygın sorunları ele almak için kolayca yapılandırılabilir ve özelleştirilebilir.

Genişletilebilir Mimari

Geliştiriciler, özelleştirilmiş ara katmanlar, genişletmeler ve yollar oluşturarak Scrapy'nin modüler ve genişletilebilir mimarisi sayesinde Scrapy'nin yeteneklerini daha fazla kişiselleştirebilir ve genişletebilir. Uyarlanabilirliği nedeniyle, geliştiriciler Scrapy'yi kolayca mevcut süreçlerine entegre edebilir ve onu kendi özel kazıma ihtiyaçlarına uyacak şekilde ayarlayabilirler.

Python'da Scrapy Oluştur ve Yapılandır

Scrapy Yükleyin

pip kullanarak aşağıdaki komutu çalıştırarak Scrapy'yi yükleyin:

pip install scrapypip install scrapyBir Tarayıcı tanımlayın

Örümceğinizi tanımlamak için spiders/ dizini altında yeni bir Python dosyası (örneğin, example.py gibi) oluşturun. İşte bir URL'den veri çeken basit bir tarayıcıya bir örnek:

import scrapy

class QuotesSpider(scrapy.Spider):

# Name of the spider

name = 'quotes'

# Starting URL

start_urls = ['http://quotes.toscrape.com']

def parse(self, response):

# Iterate through each quote block in the response

for quote in response.css('div.quote'):

# Extract and yield quote details

yield {

'text': quote.css('span.text::text').get(),

'author': quote.css('span small.author::text').get(),

'tags': quote.css('div.tags a.tag::text').getall(),

}

# Identify and follow the next page link

next_page = response.css('li.next a::attr(href)').get()

if next_page is not None:

yield response.follow(next_page, self.parse)import scrapy

class QuotesSpider(scrapy.Spider):

# Name of the spider

name = 'quotes'

# Starting URL

start_urls = ['http://quotes.toscrape.com']

def parse(self, response):

# Iterate through each quote block in the response

for quote in response.css('div.quote'):

# Extract and yield quote details

yield {

'text': quote.css('span.text::text').get(),

'author': quote.css('span small.author::text').get(),

'tags': quote.css('div.tags a.tag::text').getall(),

}

# Identify and follow the next page link

next_page = response.css('li.next a::attr(href)').get()

if next_page is not None:

yield response.follow(next_page, self.parse)Ayarları Yapılandır

Kullanıcı ajanı, indirme gecikmeleri ve prosedürler gibi Scrapy proje parametrelerini ayarlamak için settings.py dosyasını düzenleyin. Bu, kullanıcı ajanını değiştirme ve prosedürleri etkinleştirme yoluyla nasıl yapılacağını göstermektedir:

# Obey robots.txt rules

ROBOTSTXT_OBEY = True

# Set user-agent

USER_AGENT = 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'

# Configure pipelines

ITEM_PIPELINES = {

'myproject.pipelines.MyPipeline': 300,

}# Obey robots.txt rules

ROBOTSTXT_OBEY = True

# Set user-agent

USER_AGENT = 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'

# Configure pipelines

ITEM_PIPELINES = {

'myproject.pipelines.MyPipeline': 300,

}Başlarken

Scrapy ve IronPDF ile başlamak, Scrapy'nin güçlü web kazıma yeteneklerini IronPDF'nin dinamik PDF üretim özellikleri ile birleştirmeyi gerektirir. Web sitelerinden veri çıkarmanız ve IronPDF kullanarak bu verileri içeren bir PDF belgesi oluşturmanız için bir Scrapy projesi kurma adımlarını aşağıda anlatacağım.

IronPDF nedir?

IronPDF, C#, VB.NET ve diğer .NET dillerinde programlı olarak PDF belgeleri oluşturmak, düzenlemek ve değiştirmek için güçlü bir .NET kütüphanesidir. Geliştiriciler için dinamik olarak yüksek kaliteli PDF'ler oluşturmak için geniş bir özellik seti sunduğu için pek çok program için popüler bir tercihtir.

IronPDF'nin Özellikleri

PDF Oluşturma: IronPDF kullanarak, programcılar yeni PDF belgeleri oluşturabilir veya mevcut HTML elemanlarını, etiketleri, metinleri, resimleri ve diğer dosya formatlarını PDF'lere dönüştürebilir. Bu özellik, dinamik olarak raporlar, faturalar, makbuzlar ve diğer belgeler oluşturmak için çok kullanışlıdır.

HTML'den PDF'ye Dönüşüm: IronPDF, geliştiricilerin JavaScript ve CSS'den stilleri içeren HTML belgelerini PDF dosyalarına dönüştürmelerini kolaylaştırır. Bu, web sayfalarından, dinamik olarak oluşturulan içerikten ve HTML şablonlarından PDF oluşturmaya olanak tanır.

PDF Belgelerinin Değiştirilmesi ve Düzenlenmesi: IronPDF, mevcut PDF belgelerini değiştirmek ve düzenlemek için kapsamlı bir işlevsellik seti sunar. Geliştiriciler, birkaç PDF dosyasını birleştirebilir, bunları ayrı belgelere ayırabilir, sayfaları kaldırabilir ve isteğe göre PDF'leri düzenlemek için yer işaretleri, açıklamalar ve filigranlar ekleyebilir.

IronPDF nasıl kurulur

Python'un bilgisayarınıza kurulu olduğundan emin olduktan sonra, IronPDF'yi kurmak için pip'i kullanın.

pip install ironpdf

IronPDF ile Scrapy projesi

Örümceğinizi tanımlamak için Scrapy projenizin örümcek dizininde (myproject/myproject/spiders) yeni bir Python dosyası (örneğin, example.py gibi) oluşturun. Bir URL'den alıntılar çıkaran temel bir örümceğin kod örneği:

import scrapy

from IronPdf import *

class QuotesSpider(scrapy.Spider):

name = 'quotes'

# Web page link

start_urls = ['http://quotes.toscrape.com']

def parse(self, response):

quotes = []

for quote in response.css('div.quote'):

title = quote.css('span.text::text').get()

content = quote.css('span small.author::text').get()

quotes.append((title, content)) # Append quote to list

# Generate PDF document using IronPDF

renderer = ChromePdfRenderer()

pdf = renderer.RenderHtmlAsPdf(self.get_pdf_content(quotes))

pdf.SaveAs("quotes.pdf")

def get_pdf_content(self, quotes):

# Generate HTML content for PDF using extracted quotes

html_content = "<html><head><title>Quotes</title></head><body>"

for title, content in quotes:

html_content += f"<h2>{title}</h2><p>Author: {content}</p>"

html_content += "</body></html>"

return html_contentimport scrapy

from IronPdf import *

class QuotesSpider(scrapy.Spider):

name = 'quotes'

# Web page link

start_urls = ['http://quotes.toscrape.com']

def parse(self, response):

quotes = []

for quote in response.css('div.quote'):

title = quote.css('span.text::text').get()

content = quote.css('span small.author::text').get()

quotes.append((title, content)) # Append quote to list

# Generate PDF document using IronPDF

renderer = ChromePdfRenderer()

pdf = renderer.RenderHtmlAsPdf(self.get_pdf_content(quotes))

pdf.SaveAs("quotes.pdf")

def get_pdf_content(self, quotes):

# Generate HTML content for PDF using extracted quotes

html_content = "<html><head><title>Quotes</title></head><body>"

for title, content in quotes:

html_content += f"<h2>{title}</h2><p>Author: {content}</p>"

html_content += "</body></html>"

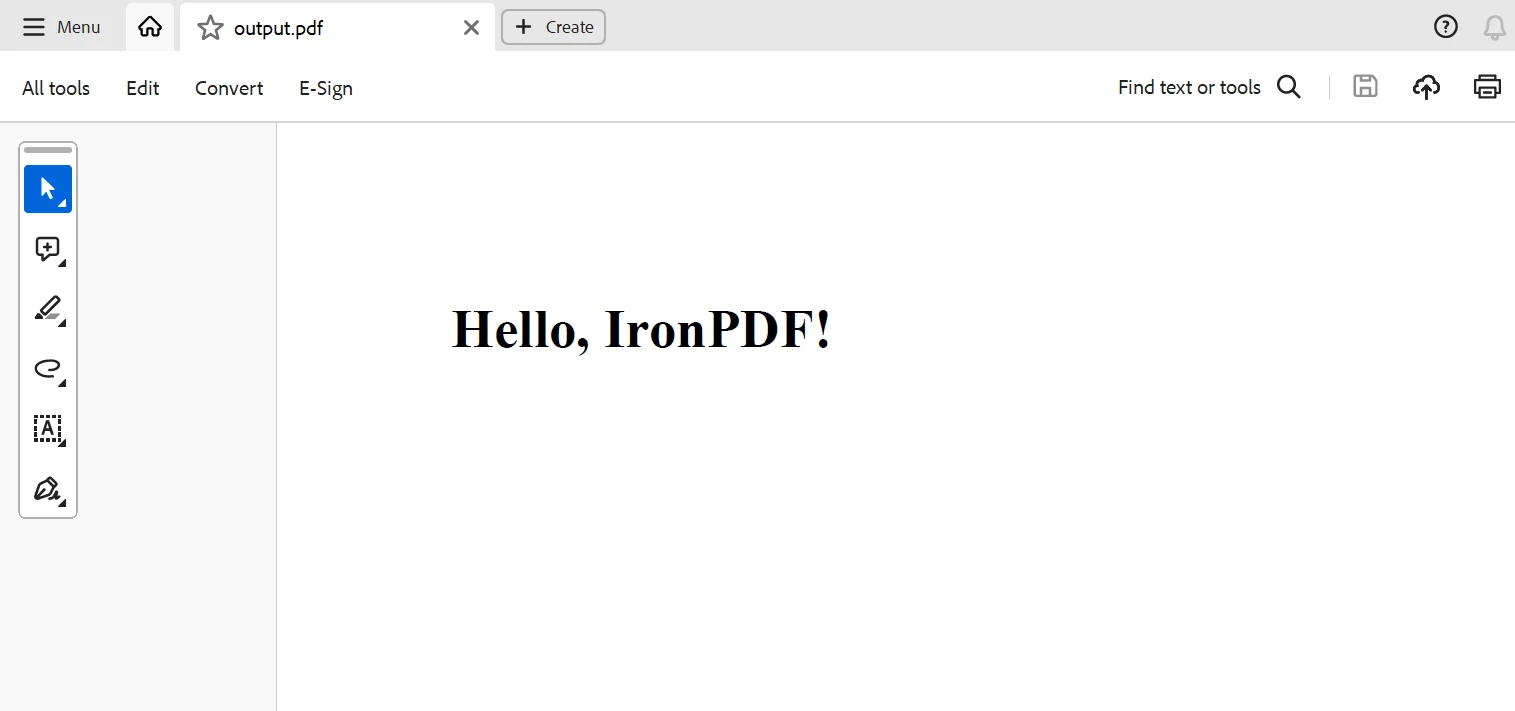

return html_contentIronPDF ile Scrapy projesinin yukarıdaki kod örneğinde, Scrapy kullanarak çıkarılan verileri kullanarak bir PDF belgesi oluşturmak için IronPDF kullanılıyor.

Burada örümceğin parse yöntemi, web sayfasından alıntılar toplar ve PDF dosyası için HTML içeriğini oluşturmak için get_pdf_content fonksiyonunu kullanır. Bu HTML materyali daha sonra IronPDF kullanılarak PDF belgesi olarak işlenir ve quotes.pdf olarak kaydedilir.

Sonuç

Özetlemek gerekirse, Scrapy ve IronPDF'nin birleşimi, geliştiricilere web kazıma görevlerini otomatikleştirmek ve anında PDF belgeleri üretmek için güçlü bir seçenek sunar. IronPDF'nin esnek PDF üretim özellikleri ile Scrapy'nin güçlü web tarama ve kazıma yetenekleri, herhangi bir web sayfasından yapılandırılmış veri toplamak ve çıkarılan verileri profesyonel kalitede PDF raporlarına, faturalarına veya belgelerine dönüştürmek için sorunsuz bir süreç sağlar.

Scrapy Spider Python'u kullanarak geliştiriciler, internetin karmaşıklıklarını etkili bir şekilde gezebilir, birçok kaynaktan bilgi alabilir ve sistematik bir şekilde düzenleyebilir. Scrapy'nin esnek çerçevesi, asenkron mimarisi ve XPath ile CSS seçici desteği, çeşitli web kazıma görevlerini yönetmek için gerekli esneklik ve ölçeklenebilirliği sağlar.

IronPDF, bir demet olarak satın alındığında, oldukça makul fiyatla ve süresiz bir lisansla birlikte gelir. Paket, sadece $999 (birçok sistem için tek seferlik satın alım) maliyetiyle mükemmel bir değer sunar. Lisans sahipleri çevrimiçi teknik destekten 7/24 yararlanabilir. Ücretle ilgili daha fazla bilgi için lütfen web sitesini ziyaret ediniz. Iron Software'ın ürünleri hakkında daha fazla bilgi edinmek için bu sayfayı ziyaret edin.

Sıkça Sorulan Sorular

Scrapy'yi bir PDF oluşturma aracı ile nasıl entegre edebilirim?

Scrapy'yi gibi bir PDF oluşturma aracı ile entegre edebilirsiniz. Önce Scrapy'yi kullanarak web sitelerinden yapılandırılmış verileri çıkarın, ardından bu verileri dinamik PDF belgelerine dönüştürmek için IronPDF'yi kullanın.

Veri kazıma ve PDF'e dönüştürmenin en iyi yolu nedir?

Veri kazıma ve PDF'e dönüştürmenin en iyi yolu, veriyi verimli bir şekilde çıkarmak için Scrapy'yi kullanmak ve çıkarılan içerikten yüksek kaliteli bir PDF üretmek için IronPDF'yi kullanmaktır.

Python'da HTML'yi PDF'ye nasıl dönüştürebilirim?

IronPDF bir .NET kütüphanesi olsa da, Python.NET gibi birlikte çalışabilirlik çözümleri aracılığıyla onu Python ile kullanabilir ve IronPDF'nin HTML'den PDF'e dönüştürme yöntemlerini kullanarak HTML'yi PDF'e dönüştürebilirsiniz.

Web scraping için Scrapy kullanmanın avantajları nelerdir?

Scrapy, asenkron işlem, sağlam XPath ve CSS seçicileri ve özelleştirilebilir ara yazılım gibi avantajlar sunarak karmaşık web sitelerinden veri çıkarmayı kolaylaştırır.

Web verilerinden PDF oluşturmayı otomatikleştirebilir miyim?

Evet, veri çıkarmak için Scrapy'yi ve PDF'ler oluşturmak için IronPDF'yi entegre ederek web verilerinden PDF oluşturmayı otomatikleştirebilirsiniz, bu da scraping'den belge oluşturma sürecine sorunsuz bir iş akışı sağlar.

Scrapy'de ara yazılımın rolü nedir?

Scrapy'deki ara yazılım, isteklerin ve yanıtların işlenmesini kontrol etmenize ve özelleştirmenize olanak tanır, otomatik URL filtreleme ve kullanıcı temsilci döndürme gibi özellikler sunar, böylece scraping verimliliğini arttırır.

Scrapy'de bir örümcek nasıl tanımlanır?

Scrapy'de bir örümcek tanımlamak için, projenizin örümcek dizininde yeni bir Python dosyası oluşturun ve veri ekstraksiyonu için parse gibi yöntemlerle scrapy.Spider sınıfını genişleten bir sınıfı uygulayın.

IronPDF'i PDF üretimi için uygun yapan şey nedir?

IronPDF, HTML'den PDF'e dönüştürme, dinamik PDF oluşturma, düzenleme ve manipülasyon için kapsamlı özellikler sunduğundan, çeşitli belge üretim ihtiyaçları için çok yönlüdür.

Web veri çıkarma ve PDF oluşturmayı nasıl geliştirebilirim?

Veri kazıma için etkili Scrapy'yi ve çıkarılan verileri profesyonel biçimlendirilmiş PDF belgelerine dönüştürmek için IronPDF'yi kullanarak web veri çıkarma ve PDF oluşturma işlemlerini geliştirin.