Przetwarzanie PDF zasilane przez AI w C#: Podsumowania, Ekstrakcja i Analiza Dokumentów z IronPDF

Przetwarzanie PDF zasilane AI w C# z IronPDF pozwala programistom .NET tworzyć podsumowania dokumentów, ekstrahować ustrukturyzowane dane i budować systemy odpowiedzi na pytania bezpośrednio na istniejących przepływach pracy PDF — używając pakietu IronPdf.Extensions.AI zbudowanego na Microsoft Semantic Kernel, aby bezproblemowo łączyć się z modelami Azure OpenAI i OpenAI. Niezależnie od tego, czy budujesz narzędzia do odkrywania prawnego, przepływy analizy finansowej, czy platformy inteligencji dokumentów, IronPDF obsługuje ekstrakcję PDF i przygotowanie kontekstu, dzięki czemu możesz skupić się na logice AI.

TL;DR: Przewodnik Quickstart

Ten samouczek obejmuje, jak podłączyć IronPDF do usług AI w celu tworzenia podsumowań dokumentów, ekstrakcji danych i inteligentnego zapytania w C# .NET.

- Dla kogo to jest: Dla programistów .NET budujących aplikacje inteligencji dokumentów — systemy odkrywania prawnego, narzędzia analizy finansowej, platformy przeglądu zgodności lub dowolną aplikację, która potrzebuje wydobyć znaczenie z dużych zbiorów dokumentów PDF.

- Co zbudujesz: Podsumowania pojedynczych dokumentów, ekstrakcję ustrukturyzowanych danych JSON z niestandardowymi schematami, odpowiedzi na pytania dotyczące treści dokumentów, RAG pipelines dla długich dokumentów i przepływy pracy przetwarzania AI w bibliotekach dokumentów.

- Gdzie to działa: W dowolnym środowisku .NET 6+ z kluczem API Azure OpenAI lub OpenAI. Rozszerzenie AI integruje się z Microsoft Semantic Kernel i zarządza automatycznie zarządzaniem oknem kontekstu, chunkingiem i orkiestracją.

- Kiedy używać tego podejścia: Kiedy aplikacja musi przetwarzać PDF-y wykraczające poza ekstrakcję tekstu — rozumienie zobowiązań umownych, podsumowywanie prac badawczych, ekstrakcja tabel finansowych jako danych strukturalnych, lub odpowiadanie na pytania użytkowników odnośnie zawartości dokumentu na dużą skalę.

- Dlaczego to ma znaczenie techniczne: Ekstrakcja surowego tekstu traci strukturę dokumentu — tabele rozpadają się, układy wielokolumnowe łamią się, a semantyczne relacje zanikają. IronPDF przygotowuje dokumenty do konsumpcji przez AI, zachowując strukturę i zarządzając limitami tokenów, dzięki czemu model otrzymuje czysty, dobrze zorganizowany input.

Podsumuj dokument PDF przy użyciu zaledwie kilku linii kodu:

-

Install IronPDF with NuGet Package Manager

PM > Install-Package IronPdf -

Skopiuj i uruchom ten fragment kodu.

await IronPdf.AI.PdfAIEngine.Summarize("contract.pdf", "summary.txt", azureEndpoint, azureApiKey); -

Wdrożenie do testowania w środowisku produkcyjnym

Rozpocznij używanie IronPDF w swoim projekcie już dziś z darmową wersją próbną

Po zakupie lub zapisaniu się na 30-dniowy okres próbny IronPDF, dodaj swój klucz licencyjny na początku aplikacji.

IronPdf.License.LicenseKey = "KEY";IronPdf.License.LicenseKey = "KEY";Imports IronPdf

IronPdf.License.LicenseKey = "KEY" Zainstaluj za pomocą NuGet

Zainstaluj za pomocą NuGet

Spis treści

- Możliwość AI + PDF

- Wbudowana integracja AI IronPDF

- Podsumowanie dokumentów

- Inteligentna ekstrakcja danych

- Odpowiadanie na pytania dotyczące dokumentów

- Przetwarzanie partii AI

- Przypadki użycia w rzeczywistości

- Rozwiązywanie problemów i pomoc techniczna

Możliwość AI + PDF

Dlaczego PDF-y są największym niewykorzystanym źródłem danych

PDF-y stanowią jedno z największych repozytoriów ustrukturyzowanej wiedzy biznesowej w nowoczesnym przedsiębiorstwie. Dokumenty profesjonalne — umowy, sprawozdania finansowe, raporty zgodności, streszczenia prawne i prace naukowe — są głównie przechowywane w formacie PDF. Te dokumenty zawierają kluczowe informacje biznesowe: warunki umów definiujące zobowiązania i odpowiedzialności, wskaźniki finansowe napędzające decyzje inwestycyjne, wymagania regulacyjne zapewniające zgodność i wyniki badań kształtujące strategię.

Jednak tradycyjne podejścia do przetwarzania PDF były poważnie ograniczone. Podstawowe narzędzia do ekstrakcji tekstu mogą wydobywać surowe znaki z strony, ale tracą one kluczowy kontekst: struktury tabel siadają do pomieszanych tekstów, układy wielokolumnowe stają się bezsensowne, a semantyczne relacje między sekcjami zanikają.

Przełom następuje dzięki zdolności AI do rozumienia kontekstu i struktury. Współczesne LLM-y nie tylko widzą słowa — rozumieją organizację dokumentu, rozpoznają wzorce, takie jak klauzule umów czy tabele finansowe, i mogą wydobywać znaczenie nawet z złożonych układów. Zunifikowany system rozumowania GPT-5 ze swoim routerem w czasie rzeczywistym i rozszerzone możliwości agentów Claude Sonnet 4.5 pokazują znacznie zmniejszoną stopę halucynacji w porównaniu do wcześniejszych modeli, czyniąc je niezawodnymi do analizy profesjonalnych dokumentów.

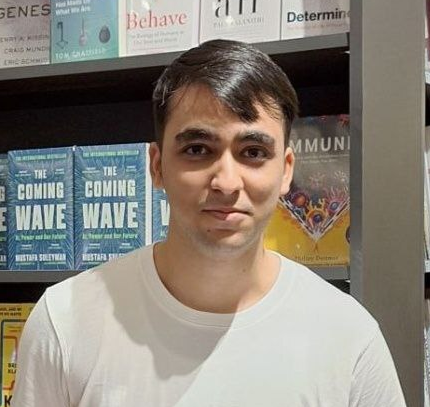

Jak LLM-y rozumieją strukturę dokumentów

Duże modele językowe wnoszą zaawansowane możliwości przetwarzania języka naturalnego do analizy PDF. Hybrydowa architektura GPT-5 obejmuje wiele sub-modeli (główny, mini, myślenie, nano) z routerem w czasie rzeczywistym, który dynamicznie wybiera optymalny wariant w zależności od złożoności zadania — proste pytania są kierowane do szybszych modeli, podczas gdy złożone zadania logiczne angażują pełny model.

Claude Opus 4.6 szczególnie wyróżnia się na długoterminowych zadaniach agentnych, z zespołami agentów, które koordynują bezpośrednio w podzielonych zadaniach i oknem kontekstowym na 1M tokenów, które może przetwarzać całe biblioteki dokumentów bez partycjonowania.

To zrozumienie kontekstu pozwala LLM na wykonywanie zadań, które wymagają prawdziwego zrozumienia. Podczas analizy umowy, LLM może zidentyfikować nie tylko klauzule zawierające słowo "rozwiązanie", ale zrozumieć konkretne warunki, pod którymi rozwiązanie jest dozwolone, wymagania dotyczące powiadomienia i wynikające z tego zobowiązania. Techniczne fundamenty umożliwiające tę zdolność to architektura transformatora, która napędza nowoczesne LLM-y, z oknem kontekstowym GPT-5 wspierającym do 272 000 tokenów wejściowych i oknem na 200K tokenów Claude Sonnet 4.5 zapewniającym kompleksowe pokrycie dokumentów.

Wbudowana integracja AI IronPDF

Instalowanie IronPDF i rozszerzeń AI

Rozpoczęcie pracy z przetwarzaniem PDF zasilanym AI wymaga biblioteki IronPDF core, pakietu rozszerzeń AI i zależności Microsoft Semantic Kernel.

Zainstaluj IronPDF za pomocą Menedżera Pakietów NuGet:

PM > Install-Package IronPdf

PM > Install-Package IronPdf.Extensions.AI

PM > Install-Package Microsoft.SemanticKernel

PM > Install-Package Microsoft.SemanticKernel.Plugins.MemoryPM > Install-Package IronPdf

PM > Install-Package IronPdf.Extensions.AI

PM > Install-Package Microsoft.SemanticKernel

PM > Install-Package Microsoft.SemanticKernel.Plugins.MemoryTe pakiety razem tworzą kompletne rozwiązanie. IronPDF zajmuje się wszystkimi operacjami związanymi z PDF — ekstrakcją tekstu, renderowaniem stron, konwersją formatu — podczas gdy rozszerzenie AI zarządza integracją z modelami językowymi za pośrednictwem Microsoft Semantic Kernel.

<NoWarn>$(NoWarn);SKEXP0001;SKEXP0010;SKEXP0050</NoWarn> do swojej Grupy Właściwości .csproj, aby wyłączyć ostrzeżenia kompilatora.Konfigurowanie klucza API OpenAI/Azure

Zanim będziesz mógł skorzystać z funkcji AI, musisz skonfigurować dostęp do dostawcy usług AI. Rozszerzenie AI IronPDF obsługuje zarówno OpenAI, jak i Azure OpenAI. Azure OpenAI jest często preferowane dla aplikacji przedsiębiorstwowych, ponieważ oferuje ulepszone funkcje bezpieczeństwa, certyfikaty zgodności i możliwość przechowywania danych w określonych regionach geograficznych.

Aby skonfigurować Azure OpenAI, będziesz potrzebować adresu URL punktu końcowego Azure, klucza API i nazw wdrożeń dla modeli czatowych i osadzających z portalu Azure.

Inicjalizowanie Silnika AI

Rozszerzenie AI IronPDF używa Microsoft Semantic Kernel pod powierzchnią. Przed skorzystaniem z jakiejkolwiek funkcji AI, musisz zainicjować kernel z poświadczeniami Azure OpenAI i skonfigurować pamięć na potrzeby przetwarzania dokumentów.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/configure-azure-credentials.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Initialize IronPDF AI with Azure OpenAI credentials

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel with Azure OpenAI

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

// Create memory store for document embeddings

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

// Initialize IronPDF AI

IronDocumentAI.Initialize(kernel, memory);

Console.WriteLine("IronPDF AI initialized successfully with Azure OpenAI");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Initialize IronPDF AI with Azure OpenAI credentials

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel with Azure OpenAI

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

' Create memory store for document embeddings

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

' Initialize IronPDF AI

IronDocumentAI.Initialize(kernel, memory)

Console.WriteLine("IronPDF AI initialized successfully with Azure OpenAI")Inicjalizacja tworzy dwa kluczowe komponenty:

- Kernel: Odpowiada za zakończenia czatu i generację osadzania tekstu przez Azure OpenAI

- Pamięć: Przechowuje osadzenia dokumentów na potrzeby operacji wyszukiwania semantycznego i pobierania

Po zainicjowaniu przez IronDocumentAI.Initialize(), możesz używać funkcji AI w całej swojej aplikacji. W przypadku aplikacji produkcyjnych zdecydowanie zaleca się przechowywanie poświadczeń w zmiennych środowiskowych lub Azure Key Vault.

Jak IronPDF Przygotowuje PDF-y do Kontekstu AI

Jednym z najtrudniejszych aspektów przetwarzania PDF zasilanego AI jest przygotowanie dokumentów do konsumpcji przez modele językowe. Podczas gdy GPT-5 obsługuje do 272 000 tokenów wejściowych, a Claude Opus 4.6 oferuje teraz okno kontekstowe z 1M tokenów, pojedyncza umowa prawna lub raport finansowy mogą łatwo przekroczyć limity starszych modeli.

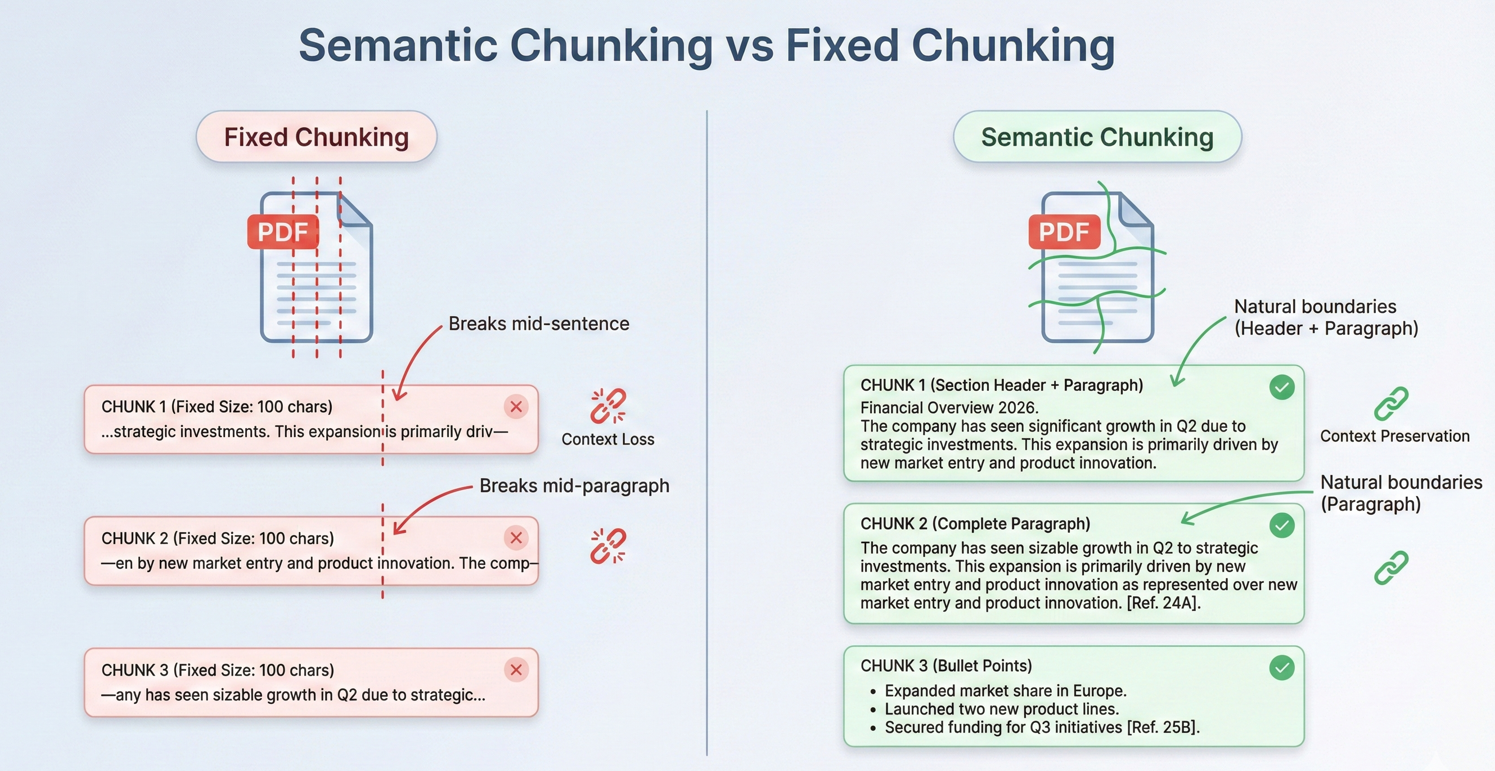

Rozszerzenie AI IronPDF radzi sobie z tą złożonością dzięki inteligentnemu przygotowaniu dokumentu. Gdy wywołasz metodę AI, IronPDF najpierw wydobywa tekst z PDF, jednocześnie zachowując informacje strukturalne — identyfikując akapity, zachowując struktury tabelowe i utrzymując relacje między sekcjami.

W przypadku dokumentów, które przekraczają limity kontekstowe, IronPDF implementuje strategiczne dzielenie na fragmenty w naturalnych punktach podziału struktury dokumentu, takich jak nagłówki sekcji, podziały stron czy granice akapitów.

Podsumowanie Dokumentów

Podsumowania Pojedynczych Dokumentów

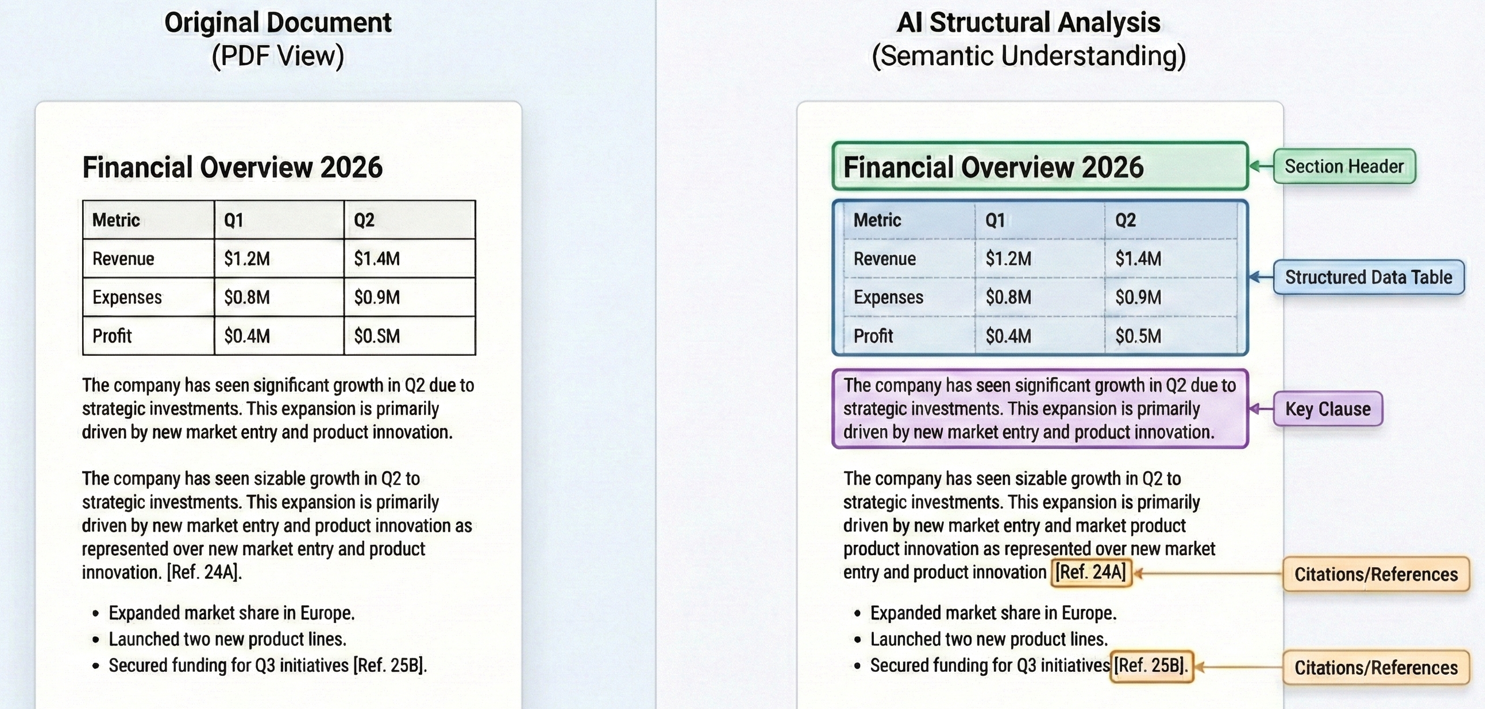

Podsumowanie dokumentów dostarcza natychmiastowej wartości, kondensując obszerne dokumenty w przyswajalne wglądy. Metoda Summarize obsługuje cały przepływ pracy: ekstrakcję tekstu, przygotowanie do spożycia przez AI, żądanie podsumowania od modelu językowego i zapisanie wyników.

Wejście

Kod ładuje PDF za pomocą PdfDocument.FromFile() i wywołuje pdf.Summarize(), aby wygenerować zwięzłe podsumowanie, a następnie zapisuje wynik do pliku tekstowego.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/single-document-summary.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Summarize a PDF document using IronPDF AI

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Load and summarize PDF

var pdf = PdfDocument.FromFile("sample-report.pdf");

string summary = await pdf.Summarize();

Console.WriteLine("Document Summary:");

Console.WriteLine(summary);

File.WriteAllText("report-summary.txt", summary);

Console.WriteLine("\nSummary saved to report-summary.txt");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Summarize a PDF document using IronPDF AI

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

' Load and summarize PDF

Dim pdf = PdfDocument.FromFile("sample-report.pdf")

Dim summary As String = Await pdf.Summarize()

Console.WriteLine("Document Summary:")

Console.WriteLine(summary)

File.WriteAllText("report-summary.txt", summary)

Console.WriteLine(vbCrLf & "Summary saved to report-summary.txt")Wynik konsoli

Proces podsumowywania wykorzystuje zaawansowane podpowiedzi, aby zapewnić wysokiej jakości wyniki. Zarówno GPT-5, jak i Claude Sonnet 4.5 w 2026 roku charakteryzują się znacznie poprawionymi możliwościami podążania za instrukcjami, zapewniając podsumowania, które uchwycają istotne informacje, pozostając zwięzłymi i czytelnymi.

Dla bardziej szczegółowego wyjaśnienia technik podsumowywania dokumentów i zaawansowanych opcji, zapoznaj się z naszym przewodnikiem jak to zrobić.

Synteza Wielu Dokumentów

Wiele scenariuszy w rzeczywistości wymaga syntezowania informacji z wielu dokumentów. Zespół prawny może potrzebować zidentyfikować wspólne klauzule w portfelu umów, lub analityk finansowy może chcieć porównać wskaźniki w raportach kwartalnych.

Podejście do syntezy wielodokumentowej polega na indywidualnym przetwarzaniu każdego dokumentu w celu wydobycia kluczowych informacji, a następnie ich agregacji w celu ostatecznej syntezy.

Ten przykład iteruje przez wiele PDF-ów, wywołując pdf.Summarize() na każdym z nich, a następnie używa pdf.Query() z połączonymi podsumowaniami, aby wygenerować zintegrowaną syntezę.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/multi-document-synthesis.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Synthesize insights across multiple related documents (e.g., quarterly reports into annual summary)

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Define documents to synthesize

string[] documentPaths = {

"Q1-report.pdf",

"Q2-report.pdf",

"Q3-report.pdf",

"Q4-report.pdf"

};

var documentSummaries = new List<string>();

// Summarize each document

foreach (string path in documentPaths)

{

var pdf = PdfDocument.FromFile(path);

string summary = await pdf.Summarize();

documentSummaries.Add($"=== {Path.GetFileName(path)} ===\n{summary}");

Console.WriteLine($"Processed: {path}");

}

// Combine and synthesize across all documents

string combinedSummaries = string.Join("\n\n", documentSummaries);

var synthesisDoc = PdfDocument.FromFile(documentPaths[0]);

string synthesisQuery = @"Based on the quarterly summaries below, provide an annual synthesis:

ll trends across quarters

chievements and challenges

over-year patterns

s:

inedSummaries;

string synthesis = await synthesisDoc.Query(synthesisQuery);

Console.WriteLine("\n=== Annual Synthesis ===");

Console.WriteLine(synthesis);

File.WriteAllText("annual-synthesis.txt", synthesis);Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.IO

' Synthesize insights across multiple related documents (e.g., quarterly reports into annual summary)

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

' Define documents to synthesize

Dim documentPaths As String() = {

"Q1-report.pdf",

"Q2-report.pdf",

"Q3-report.pdf",

"Q4-report.pdf"

}

Dim documentSummaries = New List(Of String)()

' Summarize each document

For Each path As String In documentPaths

Dim pdf = PdfDocument.FromFile(path)

Dim summary As String = Await pdf.Summarize()

documentSummaries.Add($"=== {Path.GetFileName(path)} ==={vbCrLf}{summary}")

Console.WriteLine($"Processed: {path}")

Next

' Combine and synthesize across all documents

Dim combinedSummaries As String = String.Join(vbCrLf & vbCrLf, documentSummaries)

Dim synthesisDoc = PdfDocument.FromFile(documentPaths(0))

Dim synthesisQuery As String = "Based on the quarterly summaries below, provide an annual synthesis:" & vbCrLf &

"Overall trends across quarters" & vbCrLf &

"Key achievements and challenges" & vbCrLf &

"Year-over-year patterns" & vbCrLf & vbCrLf &

combinedSummaries

Dim synthesis As String = Await synthesisDoc.Query(synthesisQuery)

Console.WriteLine(vbCrLf & "=== Annual Synthesis ===")

Console.WriteLine(synthesis)

File.WriteAllText("annual-synthesis.txt", synthesis)Ten wzorzec skutecznie skalowuje się do dużych zbiorów dokumentów. Przetwarzając dokumenty równolegle i zarządzając wynikami pośrednimi, można analizować setki lub tysiące dokumentów przy jednoczesnym zachowaniu spójnej syntezy.

Generowanie Podsumowań Wykonawczych

Podsumowania wykonawcze wymagają innego podejścia niż standardowe podsumowania. Zamiast zwykłego kondensowania treści, podsumowanie wykonawcze musi zidentyfikować najważniejsze informacje biznesowe, podkreślić kluczowe decyzje lub zalecenia i przedstawić wyniki w formacie odpowiednim do przeglądu przywództwa.

Kod używa pdf.Query() z ustrukturyzowaną podpowiedzią, żądając kluczowych decyzji, istotnych wyników, wpływu finansowego i oceny ryzyka w języku biznesowym.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/executive-summary.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Generate executive summary from strategic documents for C-suite leadership

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("strategic-plan.pdf");

string executiveQuery = @"Create an executive summary for C-suite leadership. Include:

cisions Required:**

ny decisions needing executive approval

al Findings:**

5 most important findings (bullet points)

ial Impact:**

e/cost implications if mentioned

ssessment:**

riority risks identified

ended Actions:**

ate next steps

er 500 words. Use business language appropriate for board presentation.";

string executiveSummary = await pdf.Query(executiveQuery);

File.WriteAllText("executive-summary.txt", executiveSummary);

Console.WriteLine("Executive summary saved to executive-summary.txt");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Generate executive summary from strategic documents for C-suite leadership

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("strategic-plan.pdf")

Dim executiveQuery As String = "Create an executive summary for C-suite leadership. Include:

cisions Required:**

ny decisions needing executive approval

al Findings:**

5 most important findings (bullet points)

ial Impact:**

e/cost implications if mentioned

ssessment:**

riority risks identified

ended Actions:**

ate next steps

er 500 words. Use business language appropriate for board presentation."

Dim executiveSummary As String = Await pdf.Query(executiveQuery)

File.WriteAllText("executive-summary.txt", executiveSummary)

Console.WriteLine("Executive summary saved to executive-summary.txt")Wynikowe podsumowanie wykonawcze priorytetyzuje informacje, na których można działać, ponad wszechstronne pokrycie, dostarczając dokładnie to, czego potrzebują decydenci, bez przytłaczających szczegółów.

Inteligentna Ekstrakcja Danych

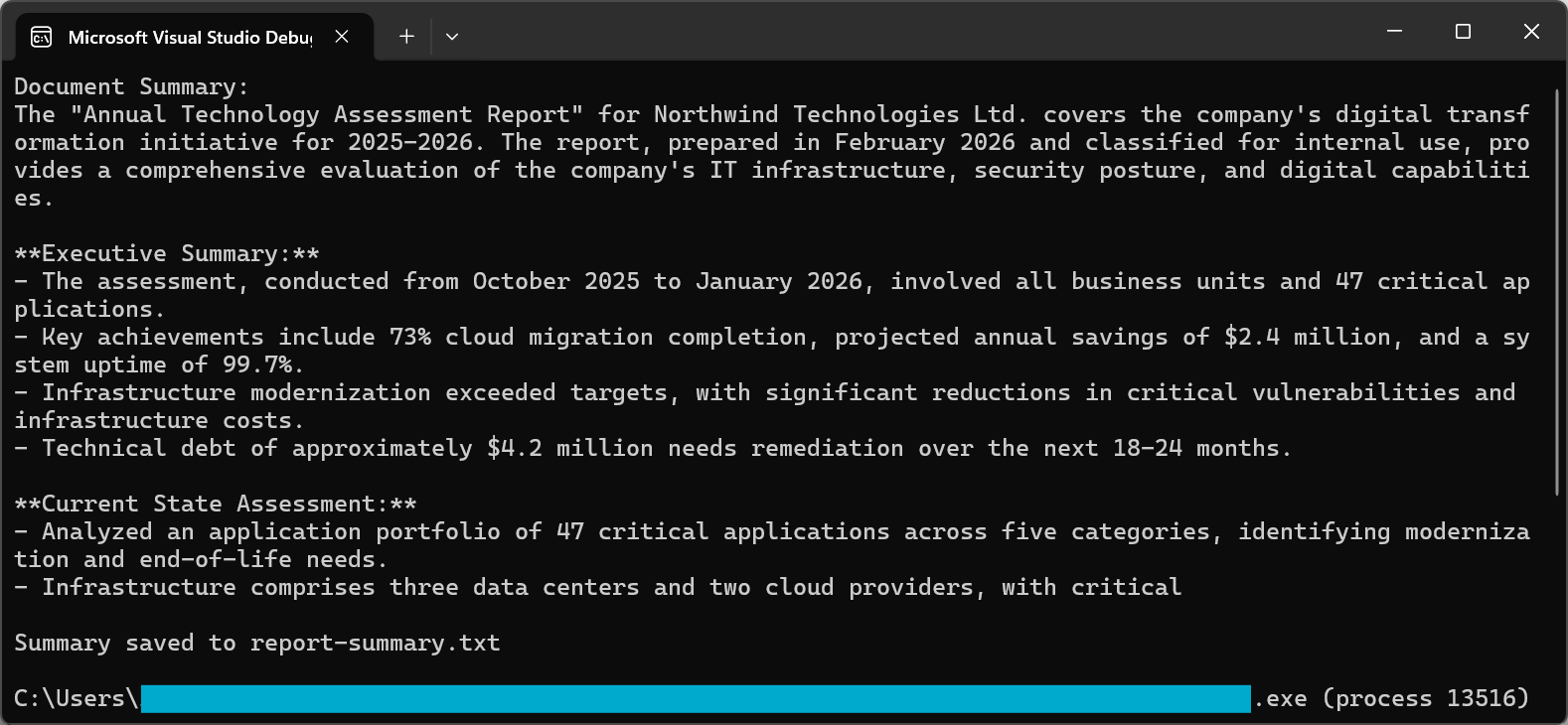

Ekstrakcja Ustrukturyzowanych Danych do JSON

Jedną z najpotężniejszych aplikacji przetwarzania PDF zasilanego AI jest ekstrakcja ustrukturyzowanych danych z nieustrukturyzowanych dokumentów. Kluczem do pomyślnej ekstrakcji strukturalnej w 2026 roku jest użycie schematów JSON z trybami wyjścia strukturalnego. GPT-5 wprowadza ulepszone strukturalne wyniki, podczas gdy Claude Sonnet 4.5 oferuje ulepszoną orkiestrację narzędzi do niezawodnej ekstrakcji danych.

Wejście

Kod wywołuje pdf.Query() z podpowiedzią schematu JSON, a następnie używa JsonSerializer.Deserialize() do parsowania i walidacji wyodrębnionych danych faktur.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/extract-invoice-json.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Extract structured invoice data as JSON from PDF

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("sample-invoice.pdf");

// Define JSON schema for extraction

string extractionQuery = @"Extract invoice data and return as JSON with this exact structure:

voiceNumber"": ""string"",

voiceDate"": ""YYYY-MM-DD"",

eDate"": ""YYYY-MM-DD"",

ndor"": {

""name"": ""string"",

""address"": ""string"",

""taxId"": ""string or null""

stomer"": {

""name"": ""string"",

""address"": ""string""

neItems"": [

{

""description"": ""string"",

""quantity"": number,

""unitPrice"": number,

""total"": number

}

btotal"": number,

xRate"": number,

xAmount"": number,

tal"": number,

rrency"": ""string""

NLY valid JSON, no additional text.";

string jsonResponse = await pdf.Query(extractionQuery);

// Parse and save JSON

try

{

var invoiceData = JsonSerializer.Deserialize<JsonElement>(jsonResponse);

string formattedJson = JsonSerializer.Serialize(invoiceData, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Extracted Invoice Data:");

Console.WriteLine(formattedJson);

File.WriteAllText("invoice-data.json", formattedJson);

}

catch (JsonException)

{

Console.WriteLine("Unable to parse JSON response");

File.WriteAllText("invoice-raw-response.txt", jsonResponse);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Extract structured invoice data as JSON from PDF

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("sample-invoice.pdf")

' Define JSON schema for extraction

Dim extractionQuery As String = "Extract invoice data and return as JSON with this exact structure:

voiceNumber"": ""string"",

voiceDate"": ""YYYY-MM-DD"",

eDate"": ""YYYY-MM-DD"",

ndor"": {

""name"": ""string"",

""address"": ""string"",

""taxId"": ""string or null""

stomer"": {

""name"": ""string"",

""address"": ""string""

neItems"": [

{

""description"": ""string"",

""quantity"": number,

""unitPrice"": number,

""total"": number

}

btotal"": number,

xRate"": number,

xAmount"": number,

tal"": number,

rrency"": ""string""

NLY valid JSON, no additional text."

Dim jsonResponse As String = Await pdf.QueryAsync(extractionQuery)

' Parse and save JSON

Try

Dim invoiceData = JsonSerializer.Deserialize(Of JsonElement)(jsonResponse)

Dim formattedJson As String = JsonSerializer.Serialize(invoiceData, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Extracted Invoice Data:")

Console.WriteLine(formattedJson)

File.WriteAllText("invoice-data.json", formattedJson)

Catch ex As JsonException

Console.WriteLine("Unable to parse JSON response")

File.WriteAllText("invoice-raw-response.txt", jsonResponse)

End TryCzęściowy zrzut ekranu wygenerowanego pliku JSON

Współczesne modele AI w 2026 roku obsługują strukturalne tryby wyjścia, które gwarantują prawidłowe reakcje JSON zgodne z dostarczonymi schematami. To eliminuje potrzebę złożonego obsługi błędów wokół nieprawidłowych odpowiedzi.

Identyfikacja Klauzul w Umowach

Umowy prawne zawierają określone typy klauzul, które mają szczególne znaczenie: postanowienia o rozwiązaniu, ograniczenia odpowiedzialności, wymagania dotyczące odszkodowania, przydział własności intelektualnej i zobowiązania do zachowania poufności. Identyfikacja klauzul zasilana przez AI automatyzuje tę analizę przy jednoczesnym zachowaniu wysokiej dokładności.

Ten przykład używa pdf.Query() z fokusem na klauzule w schemacie JSON, aby wyodrębnić typ umowy, strony, kluczowe daty i poszczególne klauzule z poziomami ryzyka.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/contract-clause-analysis.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Analyze contract clauses and identify key terms, risks, and critical dates

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("contract.pdf");

// Define JSON schema for contract analysis

string clauseQuery = @"Analyze this contract and identify key clauses. Return JSON:

ntractType"": ""string"",

rties"": [""string""],

fectiveDate"": ""string"",

auses"": [

{

""type"": ""Termination|Liability|Indemnification|Confidentiality|IP|Payment|Warranty|Other"",

""title"": ""string"",

""summary"": ""string"",

""riskLevel"": ""Low|Medium|High"",

""keyTerms"": [""string""]

}

iticalDates"": [

{

""description"": ""string"",

""date"": ""string""

}

erallRiskAssessment"": ""Low|Medium|High"",

commendations"": [""string""]

: termination rights, liability caps, indemnification, IP ownership, confidentiality, payment terms.

NLY valid JSON.";

string analysisJson = await pdf.Query(clauseQuery);

try

{

var analysis = JsonSerializer.Deserialize<JsonElement>(analysisJson);

string formatted = JsonSerializer.Serialize(analysis, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Contract Clause Analysis:");

Console.WriteLine(formatted);

File.WriteAllText("contract-analysis.json", formatted);

// Display high-risk clauses

Console.WriteLine("\n=== High Risk Clauses ===");

foreach (var clause in analysis.GetProperty("clauses").EnumerateArray())

{

if (clause.GetProperty("riskLevel").GetString() == "High")

{

Console.WriteLine($"- {clause.GetProperty("type")}: {clause.GetProperty("summary")}");

}

}

}

catch (JsonException)

{

Console.WriteLine("Unable to parse contract analysis");

File.WriteAllText("contract-analysis-raw.txt", analysisJson);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Analyze contract clauses and identify key terms, risks, and critical dates

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("contract.pdf")

' Define JSON schema for contract analysis

Dim clauseQuery As String = "Analyze this contract and identify key clauses. Return JSON:

ntractType"": ""string"",

rties"": [""string""],

fectiveDate"": ""string"",

auses"": [

{

""type"": ""Termination|Liability|Indemnification|Confidentiality|IP|Payment|Warranty|Other"",

""title"": ""string"",

""summary"": ""string"",

""riskLevel"": ""Low|Medium|High"",

""keyTerms"": [""string""]

}

iticalDates"": [

{

""description"": ""string"",

""date"": ""string""

}

erallRiskAssessment"": ""Low|Medium|High"",

commendations"": [""string""]

: termination rights, liability caps, indemnification, IP ownership, confidentiality, payment terms.

NLY valid JSON."

Dim analysisJson As String = Await pdf.Query(clauseQuery)

Try

Dim analysis = JsonSerializer.Deserialize(Of JsonElement)(analysisJson)

Dim formatted As String = JsonSerializer.Serialize(analysis, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Contract Clause Analysis:")

Console.WriteLine(formatted)

File.WriteAllText("contract-analysis.json", formatted)

' Display high-risk clauses

Console.WriteLine(vbCrLf & "=== High Risk Clauses ===")

For Each clause In analysis.GetProperty("clauses").EnumerateArray()

If clause.GetProperty("riskLevel").GetString() = "High" Then

Console.WriteLine($"- {clause.GetProperty("type")}: {clause.GetProperty("summary")}")

End If

Next

Catch ex As JsonException

Console.WriteLine("Unable to parse contract analysis")

File.WriteAllText("contract-analysis-raw.txt", analysisJson)

End TryTa zdolność przekształca przegląd umów z procesu sekwencyjnego, ręcznego, w zautomatyzowany, skalowalny przepływ pracy. Zespoły prawników mogą szybko zidentyfikować klauzule wysokiego ryzyka w setkach umów.

Parsowanie Danych Finansowych

Dokumenty finansowe zawierają kluczowe dane ilościowe osadzone w złożonych narracjach i tabelach. Parsowanie zasilane AI w dokumentach finansowych wyróżnia się, ponieważ rozumie kontekst — odróżniając wyniki historyczne od prognoz na przyszłość, identyfikując, czy liczby są w tysiącach czy milionach, i rozumiejąc relacje między różnymi wskaźnikami.

Kod używa pdf.Query() z schematem JSON finansowym, aby wydobyć dane dotyczące sprawozdań finansowych, wskaźników bilansu i przewodników na przyszłość do strukturalnego wyjścia.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/financial-data-extraction.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Extract financial metrics from annual reports and earnings documents

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("annual-report.pdf");

// Define JSON schema for financial extraction (numbers in millions)

string financialQuery = @"Extract financial metrics from this document. Return JSON:

portPeriod"": ""string"",

mpany"": ""string"",

rrency"": ""string"",

comeStatement"": {

""revenue"": number,

""costOfRevenue"": number,

""grossProfit"": number,

""operatingExpenses"": number,

""operatingIncome"": number,

""netIncome"": number,

""eps"": number

lanceSheet"": {

""totalAssets"": number,

""totalLiabilities"": number,

""shareholdersEquity"": number,

""cash"": number,

""totalDebt"": number

yMetrics"": {

""revenueGrowthYoY"": ""string"",

""grossMargin"": ""string"",

""operatingMargin"": ""string"",

""netMargin"": ""string"",

""debtToEquity"": number

idance"": {

""nextQuarterRevenue"": ""string"",

""fullYearRevenue"": ""string"",

""notes"": ""string""

for unavailable data. Numbers in millions unless stated.

NLY valid JSON.";

string financialJson = await pdf.Query(financialQuery);

try

{

var financials = JsonSerializer.Deserialize<JsonElement>(financialJson);

string formatted = JsonSerializer.Serialize(financials, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Extracted Financial Data:");

Console.WriteLine(formatted);

File.WriteAllText("financial-data.json", formatted);

}

catch (JsonException)

{

Console.WriteLine("Unable to parse financial data");

File.WriteAllText("financial-raw.txt", financialJson);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Extract financial metrics from annual reports and earnings documents

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("annual-report.pdf")

' Define JSON schema for financial extraction (numbers in millions)

Dim financialQuery As String = "Extract financial metrics from this document. Return JSON:

portPeriod"": ""string"",

mpany"": ""string"",

rrency"": ""string"",

comeStatement"": {

""revenue"": number,

""costOfRevenue"": number,

""grossProfit"": number,

""operatingExpenses"": number,

""operatingIncome"": number,

""netIncome"": number,

""eps"": number

lanceSheet"": {

""totalAssets"": number,

""totalLiabilities"": number,

""shareholdersEquity"": number,

""cash"": number,

""totalDebt"": number

yMetrics"": {

""revenueGrowthYoY"": ""string"",

""grossMargin"": ""string"",

""operatingMargin"": ""string"",

""netMargin"": ""string"",

""debtToEquity"": number

idance"": {

""nextQuarterRevenue"": ""string"",

""fullYearRevenue"": ""string"",

""notes"": ""string""

for unavailable data. Numbers in millions unless stated.

NLY valid JSON."

Dim financialJson As String = Await pdf.Query(financialQuery)

Try

Dim financials = JsonSerializer.Deserialize(Of JsonElement)(financialJson)

Dim formatted As String = JsonSerializer.Serialize(financials, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Extracted Financial Data:")

Console.WriteLine(formatted)

File.WriteAllText("financial-data.json", formatted)

Catch ex As JsonException

Console.WriteLine("Unable to parse financial data")

File.WriteAllText("financial-raw.txt", financialJson)

End TryWyodrębnione strukturalne dane mogą bezpośrednio zasilać modele finansowe, bazy danych szeregów czasowych lub platformy analityczne, umożliwiając automatyczne śledzenie wskaźników w okresach sprawozdawczych.

Niestandardowe Prompty Ekstrakcji

Wiele organizacji ma unikalne wymagania dotyczące ekstrakcji w zależności od ich konkretnej domeny, formatów dokumentów lub procesów biznesowych. Integracja AI IronPDF w pełni obsługuje niestandardowe prompty ekstrakcji, pozwalając na zdefiniowanie, jakie informacje mają być wyodrębnione i jak mają być ustrukturyzowane.

Ten przykład pokazuje pdf.Query() z schematem skoncentrowanym na badaniach, wyodrębniającym metodologię, kluczowe ustalenia z poziomami pewności i ograniczenia z prac naukowych.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/custom-research-extraction.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Extract structured research metadata from academic papers

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("research-paper.pdf");

// Define JSON schema for research paper extraction

string researchQuery = @"Extract structured information from this research paper. Return JSON:

tle"": ""string"",

thors"": [""string""],

stitution"": ""string"",

blicationDate"": ""string"",

stract"": ""string"",

searchQuestion"": ""string"",

thodology"": {

""type"": ""Quantitative|Qualitative|Mixed Methods"",

""approach"": ""string"",

""sampleSize"": ""string"",

""dataCollection"": ""string""

yFindings"": [

{

""finding"": ""string"",

""significance"": ""string"",

""confidence"": ""High|Medium|Low""

}

mitations"": [""string""],

tureWork"": [""string""],

ywords"": [""string""]

extracting verifiable claims and noting uncertainty.

NLY valid JSON.";

string extractionResult = await pdf.Query(researchQuery);

try

{

var research = JsonSerializer.Deserialize<JsonElement>(extractionResult);

string formatted = JsonSerializer.Serialize(research, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Research Paper Extraction:");

Console.WriteLine(formatted);

File.WriteAllText("research-extraction.json", formatted);

// Display key findings with confidence levels

Console.WriteLine("\n=== Key Findings ===");

foreach (var finding in research.GetProperty("keyFindings").EnumerateArray())

{

string confidence = finding.GetProperty("confidence").GetString() ?? "Unknown";

Console.WriteLine($"[{confidence}] {finding.GetProperty("finding")}");

}

}

catch (JsonException)

{

Console.WriteLine("Unable to parse research extraction");

File.WriteAllText("research-raw.txt", extractionResult);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Extract structured research metadata from academic papers

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("research-paper.pdf")

' Define JSON schema for research paper extraction

Dim researchQuery As String = "Extract structured information from this research paper. Return JSON:

tle"": ""string"",

thors"": [""string""],

stitution"": ""string"",

blicationDate"": ""string"",

stract"": ""string"",

searchQuestion"": ""string"",

thodology"": {

""type"": ""Quantitative|Qualitative|Mixed Methods"",

""approach"": ""string"",

""sampleSize"": ""string"",

""dataCollection"": ""string""

yFindings"": [

{

""finding"": ""string"",

""significance"": ""string"",

""confidence"": ""High|Medium|Low""

}

mitations"": [""string""],

tureWork"": [""string""],

ywords"": [""string""]

extracting verifiable claims and noting uncertainty.

NLY valid JSON."

Dim extractionResult As String = Await pdf.Query(researchQuery)

Try

Dim research = JsonSerializer.Deserialize(Of JsonElement)(extractionResult)

Dim formatted As String = JsonSerializer.Serialize(research, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Research Paper Extraction:")

Console.WriteLine(formatted)

File.WriteAllText("research-extraction.json", formatted)

' Display key findings with confidence levels

Console.WriteLine(vbCrLf & "=== Key Findings ===")

For Each finding In research.GetProperty("keyFindings").EnumerateArray()

Dim confidence As String = finding.GetProperty("confidence").GetString() OrElse "Unknown"

Console.WriteLine($"[{confidence}] {finding.GetProperty("finding")}")

Next

Catch ex As JsonException

Console.WriteLine("Unable to parse research extraction")

File.WriteAllText("research-raw.txt", extractionResult)

End TryNiestandardowe prompty przekształcają ekstrakcję zasilaną AI z narzędzia ogólnego w wyspecjalizowane rozwiązanie dostosowane do Twoich konkretnych potrzeb.

Odpowiadanie na Pytania Dotyczące Dokumentów

Tworzenie Systemu Pytania-Odpowiedzi dla PDF

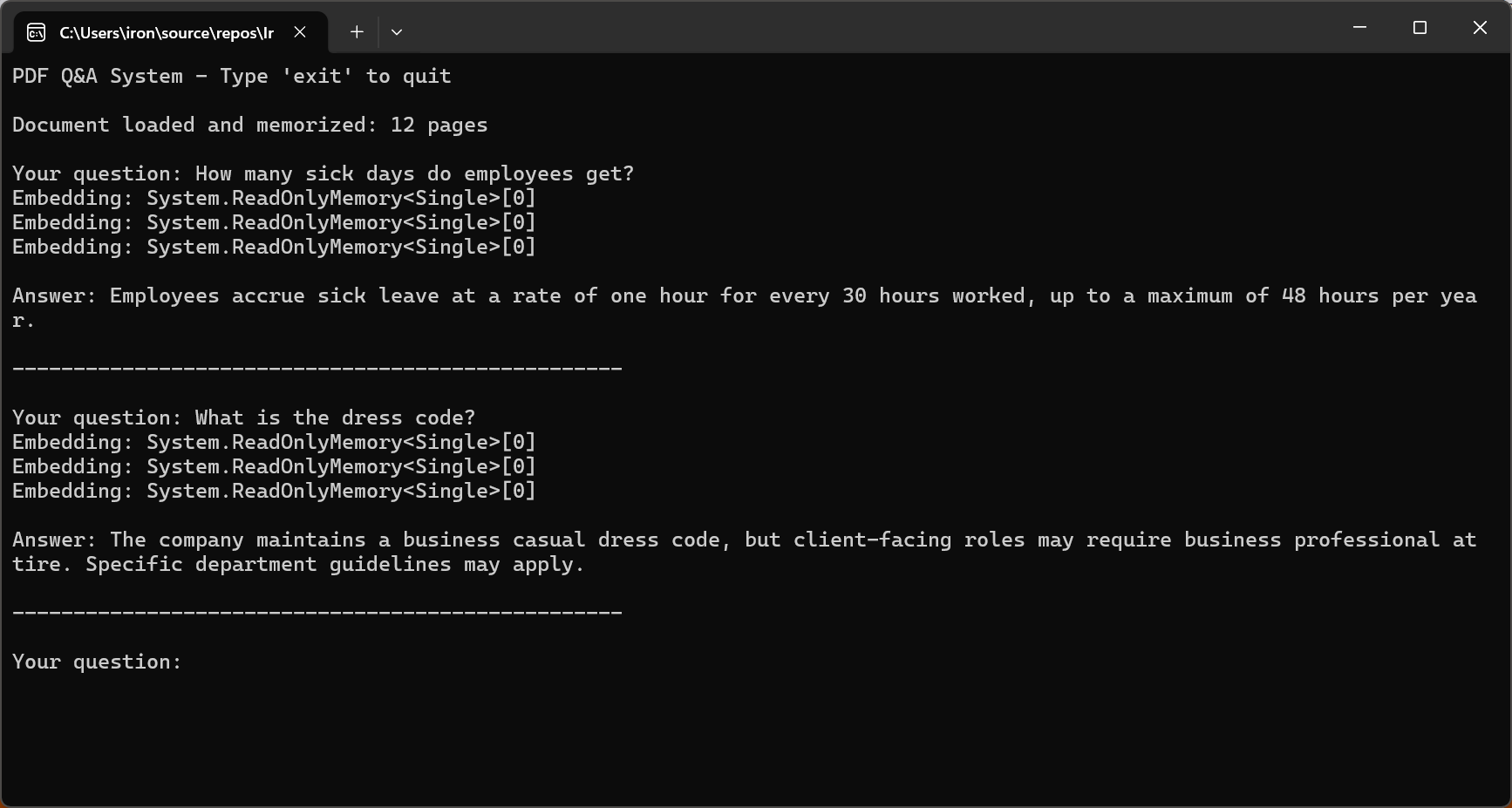

Systemy pytania-odpowiedzi umożliwiają użytkownikom interakcję z dokumentami PDF w sposób konwersacyjny, zadawanie pytań w języku naturalnym i otrzymywanie dokładnych, kontekstowych odpowiedzi. Podstawowy wzorzec polega na ekstrakcji tekstu z PDF, połączeniu go z pytaniem użytkownika w podpowiedzi i żądaniu odpowiedzi od AI.

Wejście

Kod wywołuje pdf.Memorize(), aby indeksować dokument pod kątem wyszukiwania semantycznego, a następnie wchodzi w interaktywną pętlę używając pdf.Query(), aby odpowiadać na pytania użytkowników.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/pdf-question-answering.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Interactive Q&A system for querying PDF documents

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("sample-legal-document.pdf");

// Memorize document to enable persistent querying

await pdf.Memorize();

Console.WriteLine("PDF Q&A System - Type 'exit' to quit\n");

Console.WriteLine($"Document loaded and memorized: {pdf.PageCount} pages\n");

// Interactive Q&A loop

while (true)

{

Console.Write("Your question: ");

string? question = Console.ReadLine();

if (string.IsNullOrWhiteSpace(question) || question.ToLower() == "exit")

break;

string answer = await pdf.Query(question);

Console.WriteLine($"\nAnswer: {answer}\n");

Console.WriteLine(new string('-', 50) + "\n");

}

Console.WriteLine("Q&A session ended.");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Interactive Q&A system for querying PDF documents

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("sample-legal-document.pdf")

' Memorize document to enable persistent querying

Await pdf.Memorize()

Console.WriteLine("PDF Q&A System - Type 'exit' to quit" & vbCrLf)

Console.WriteLine($"Document loaded and memorized: {pdf.PageCount} pages" & vbCrLf)

' Interactive Q&A loop

While True

Console.Write("Your question: ")

Dim question As String = Console.ReadLine()

If String.IsNullOrWhiteSpace(question) OrElse question.ToLower() = "exit" Then

Exit While

End If

Dim answer As String = Await pdf.Query(question)

Console.WriteLine($"{vbCrLf}Answer: {answer}{vbCrLf}")

Console.WriteLine(New String("-"c, 50) & vbCrLf)

End While

Console.WriteLine("Q&A session ended.")Wynik konsoli

Kluczem do efektywnego systemu pytania-odpowiedzi w 2026 roku jest ograniczenie AI do odpowiedzi wyłącznie na podstawie treści dokumentu. Metoda "bezpiecznych zakończeń" trenowania GPT-5 i ulepszona zgodność Claude Sonnet 4.5 znacznie redukują stopę halucynacji.

Podział Długich Dokumentów dla Okien Kontekstowych

Większość dokumentów w rzeczywistości przekracza okna kontekstowe AI. Efektywne strategie podziału są niezbędne do przetwarzania tych dokumentów. Podział polega na dzieleniu dokumentów na segmenty wystarczająco małe, aby zmieścić się w oknach kontekstowych, jednocześnie zachowując spójność semantyczną.

Kod iteruje przez pdf.Pages, tworząc obiekty DocumentChunk z konfigurowalnymi maxChunkTokens i overlapTokens dla ciągłości kontekstu.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/semantic-document-chunking.csusing IronPdf;

// Split long documents into overlapping chunks for RAG systems

var pdf = PdfDocument.FromFile("long-document.pdf");

// Chunking configuration

int maxChunkTokens = 4000; // Leave room for prompts and responses

int overlapTokens = 200; // Overlap for context continuity

int approxCharsPerToken = 4; // Rough estimate for tokenization

int maxChunkChars = maxChunkTokens * approxCharsPerToken;

int overlapChars = overlapTokens * approxCharsPerToken;

var chunks = new List<DocumentChunk>();

var currentChunk = new System.Text.StringBuilder();

int chunkStartPage = 1;

int currentPage = 1;

for (int i = 0; i < pdf.PageCount; i++)

{

string pageText = pdf.Pages[i].Text;

currentPage = i + 1;

if (currentChunk.Length + pageText.Length > maxChunkChars && currentChunk.Length > 0)

{

chunks.Add(new DocumentChunk

{

Text = currentChunk.ToString(),

StartPage = chunkStartPage,

EndPage = currentPage - 1,

ChunkIndex = chunks.Count

});

// Create overlap with previous chunk for continuity

string overlap = currentChunk.Length > overlapChars

? currentChunk.ToString().Substring(currentChunk.Length - overlapChars)

: currentChunk.ToString();

currentChunk.Clear();

currentChunk.Append(overlap);

chunkStartPage = currentPage - 1;

}

currentChunk.AppendLine($"\n--- Page {currentPage} ---\n");

currentChunk.Append(pageText);

}

if (currentChunk.Length > 0)

{

chunks.Add(new DocumentChunk

{

Text = currentChunk.ToString(),

StartPage = chunkStartPage,

EndPage = currentPage,

ChunkIndex = chunks.Count

});

}

Console.WriteLine($"Document chunked into {chunks.Count} segments");

foreach (var chunk in chunks)

{

Console.WriteLine($" Chunk {chunk.ChunkIndex + 1}: Pages {chunk.StartPage}-{chunk.EndPage} ({chunk.Text.Length} chars)");

}

// Save chunk metadata for RAG indexing

File.WriteAllText("chunks-metadata.json", System.Text.Json.JsonSerializer.Serialize(

chunks.Select(c => new { c.ChunkIndex, c.StartPage, c.EndPage, Length = c.Text.Length }),

new System.Text.Json.JsonSerializerOptions { WriteIndented = true }

));

ic class DocumentChunk

public string Text { get; set; } = "";

public int StartPage { get; set; }

public int EndPage { get; set; }

public int ChunkIndex { get; set; }Imports IronPdf

Imports System.IO

Imports System.Text

Imports System.Text.Json

' Split long documents into overlapping chunks for RAG systems

Dim pdf = PdfDocument.FromFile("long-document.pdf")

' Chunking configuration

Dim maxChunkTokens As Integer = 4000 ' Leave room for prompts and responses

Dim overlapTokens As Integer = 200 ' Overlap for context continuity

Dim approxCharsPerToken As Integer = 4 ' Rough estimate for tokenization

Dim maxChunkChars As Integer = maxChunkTokens * approxCharsPerToken

Dim overlapChars As Integer = overlapTokens * approxCharsPerToken

Dim chunks As New List(Of DocumentChunk)()

Dim currentChunk As New StringBuilder()

Dim chunkStartPage As Integer = 1

Dim currentPage As Integer = 1

For i As Integer = 0 To pdf.PageCount - 1

Dim pageText As String = pdf.Pages(i).Text

currentPage = i + 1

If currentChunk.Length + pageText.Length > maxChunkChars AndAlso currentChunk.Length > 0 Then

chunks.Add(New DocumentChunk With {

.Text = currentChunk.ToString(),

.StartPage = chunkStartPage,

.EndPage = currentPage - 1,

.ChunkIndex = chunks.Count

})

' Create overlap with previous chunk for continuity

Dim overlap As String = If(currentChunk.Length > overlapChars,

currentChunk.ToString().Substring(currentChunk.Length - overlapChars),

currentChunk.ToString())

currentChunk.Clear()

currentChunk.Append(overlap)

chunkStartPage = currentPage - 1

End If

currentChunk.AppendLine(vbCrLf & "--- Page " & currentPage & " ---" & vbCrLf)

currentChunk.Append(pageText)

Next

If currentChunk.Length > 0 Then

chunks.Add(New DocumentChunk With {

.Text = currentChunk.ToString(),

.StartPage = chunkStartPage,

.EndPage = currentPage,

.ChunkIndex = chunks.Count

})

End If

Console.WriteLine($"Document chunked into {chunks.Count} segments")

For Each chunk In chunks

Console.WriteLine($" Chunk {chunk.ChunkIndex + 1}: Pages {chunk.StartPage}-{chunk.EndPage} ({chunk.Text.Length} chars)")

Next

' Save chunk metadata for RAG indexing

File.WriteAllText("chunks-metadata.json", JsonSerializer.Serialize(

chunks.Select(Function(c) New With {.ChunkIndex = c.ChunkIndex, .StartPage = c.StartPage, .EndPage = c.EndPage, .Length = c.Text.Length}),

New JsonSerializerOptions With {.WriteIndented = True}

))

Public Class DocumentChunk

Public Property Text As String = ""

Public Property StartPage As Integer

Public Property EndPage As Integer

Public Property ChunkIndex As Integer

End Class

Nakładające się segmenty zapewniają ciągłość w poprzek granic, zapewniając, że AI ma wystarczający kontekst, nawet gdy istotne informacje obejmują granice segmentów.

Wzorce RAG (Retrieval-Augmented Generation)

Retrieval-Augmented Generation reprezentuje potężny wzorzec analizy dokumentów zasilanej AI w 2026 roku. Zamiast podawać AI całe dokumenty, systemy RAG najpierw wyszukują jedynie istotne fragmenty dla danego zapytania, a następnie używają tych fragmentów jako kontekstu do generowania odpowiedzi.

Przepływ pracy RAG ma trzy główne fazy: przygotowanie dokumentu (podział i tworzenie osadzeń), wyszukiwanie (przeszukiwanie istotnych fragmentów) i generacja (użycie pobranych fragmentów jako kontekstu dla odpowiedzi AI).

Kod indeksuje wiele PDF-ów, wywołując pdf.Memorize() na każdej z nich, a następnie używa pdf.Query(), aby pobrać odpowiedzi z połączonej pamięci dokumentowej.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/rag-system-implementation.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Retrieval-Augmented Generation (RAG) system for querying across multiple indexed documents

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Index all documents in folder

string[] documentPaths = Directory.GetFiles("documents/", "*.pdf");

Console.WriteLine($"Indexing {documentPaths.Length} documents...\n");

// Memorize each document (creates embeddings for retrieval)

foreach (string path in documentPaths)

{

var pdf = PdfDocument.FromFile(path);

await pdf.Memorize();

Console.WriteLine($"Indexed: {Path.GetFileName(path)} ({pdf.PageCount} pages)");

}

Console.WriteLine("\n=== RAG System Ready ===\n");

// Query across all indexed documents

string query = "What are the key compliance requirements for data retention?";

Console.WriteLine($"Query: {query}\n");

var searchPdf = PdfDocument.FromFile(documentPaths[0]);

string answer = await searchPdf.Query(query);

Console.WriteLine($"Answer: {answer}");

// Interactive query loop

Console.WriteLine("\n--- Enter questions (type 'exit' to quit) ---\n");

while (true)

{

Console.Write("Question: ");

string? userQuery = Console.ReadLine();

if (string.IsNullOrWhiteSpace(userQuery) || userQuery.ToLower() == "exit")

break;

string response = await searchPdf.Query(userQuery);

Console.WriteLine($"\nAnswer: {response}\n");

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.IO

' Retrieval-Augmented Generation (RAG) system for querying across multiple indexed documents

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

' Index all documents in folder

Dim documentPaths As String() = Directory.GetFiles("documents/", "*.pdf")

Console.WriteLine($"Indexing {documentPaths.Length} documents..." & vbCrLf)

' Memorize each document (creates embeddings for retrieval)

For Each path As String In documentPaths

Dim pdf = PdfDocument.FromFile(path)

Await pdf.Memorize()

Console.WriteLine($"Indexed: {Path.GetFileName(path)} ({pdf.PageCount} pages)")

Next

Console.WriteLine(vbCrLf & "=== RAG System Ready ===" & vbCrLf)

' Query across all indexed documents

Dim query As String = "What are the key compliance requirements for data retention?"

Console.WriteLine($"Query: {query}" & vbCrLf)

Dim searchPdf = PdfDocument.FromFile(documentPaths(0))

Dim answer As String = Await searchPdf.Query(query)

Console.WriteLine($"Answer: {answer}")

' Interactive query loop

Console.WriteLine(vbCrLf & "--- Enter questions (type 'exit' to quit) ---" & vbCrLf)

While True

Console.Write("Question: ")

Dim userQuery As String = Console.ReadLine()

If String.IsNullOrWhiteSpace(userQuery) OrElse userQuery.ToLower() = "exit" Then

Exit While

End If

Dim response As String = Await searchPdf.Query(userQuery)

Console.WriteLine(vbCrLf & $"Answer: {response}" & vbCrLf)

End WhileSystemy RAG doskonale radzą sobie z dużymi kolekcjami dokumentów — bazami danych spraw prawnych, bibliotekami dokumentacji technicznej, archiwami badań. Pobierając jedynie istotne fragmenty, zachowują jakość odpowiedzi, przy jednoczesnym skalowaniu do praktycznie nieograniczonych rozmiarów dokumentów.

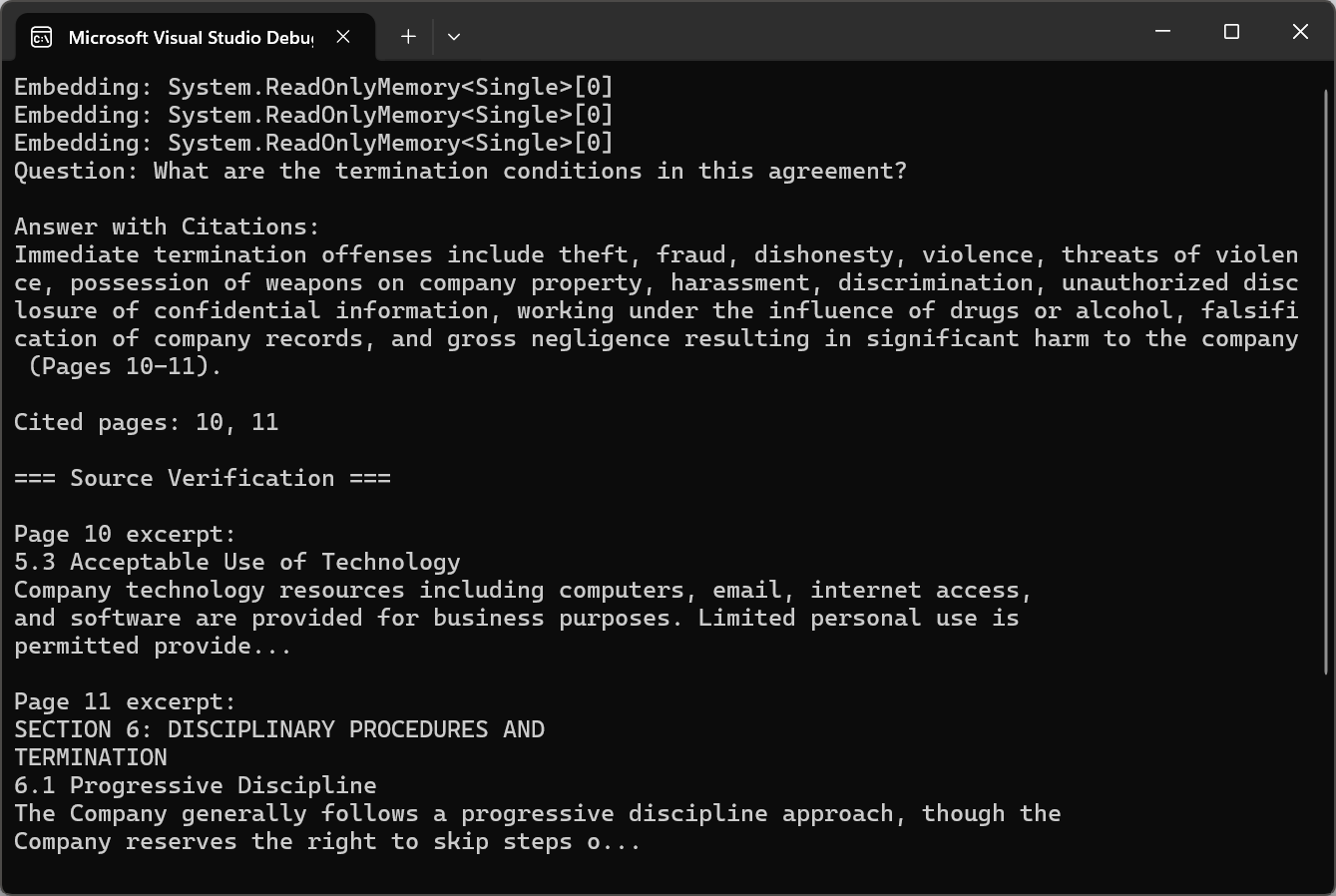

Podawanie Źródeł z Stron PDF

Dla profesjonalnych aplikacji, odpowiedzi AI muszą być weryfikowalne. Podejście oparte na cytowaniu polega na utrzymaniu metadanych o pochodzeniu fragmentów podczas podziału i pobierania. Każdy fragment przechowuje nie tylko treść tekstową, ale także numery stron źródłowych, nagłówki sekcji i pozycję w dokumencie.

Wejście

Kod używa pdf.Query() z instrukcjami cytowania, a następnie wywołuje ExtractCitedPages() z regexem, aby analizować odniesienia do stron i weryfikować źródła używając pdf.Pages[pageNum - 1].Text.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/answer-with-citations.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.RegularExpressions;

// Answer questions with page citations and source verification

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("sample-legal-document.pdf");

await pdf.Memorize();

string question = "What are the termination conditions in this agreement?";

// Request citations in query

string citationQuery = $@"{question}

T: Include specific page citations in your answer using the format (Page X) or (Pages X-Y).

e information that appears in the document.";

string answerWithCitations = await pdf.Query(citationQuery);

Console.WriteLine("Question: " + question);

Console.WriteLine("\nAnswer with Citations:");

Console.WriteLine(answerWithCitations);

// Extract cited page numbers using regex

var citedPages = ExtractCitedPages(answerWithCitations);

Console.WriteLine($"\nCited pages: {string.Join(", ", citedPages)}");

// Verify citations with page excerpts

Console.WriteLine("\n=== Source Verification ===");

foreach (int pageNum in citedPages.Take(3))

{

if (pageNum <= pdf.PageCount && pageNum > 0)

{

string pageText = pdf.Pages[pageNum - 1].Text;

string excerpt = pageText.Length > 200 ? pageText.Substring(0, 200) + "..." : pageText;

Console.WriteLine($"\nPage {pageNum} excerpt:\n{excerpt}");

}

}

// Extract page numbers from citation format (Page X) or (Pages X-Y)

List<int> ExtractCitedPages(string text)

{

var pages = new HashSet<int>();

var matches = Regex.Matches(text, @"\(Pages?\s*(\d+)(?:\s*-\s*(\d+))?\)", RegexOptions.IgnoreCase);

foreach (Match match in matches)

{

int startPage = int.Parse(match.Groups[1].Value);

pages.Add(startPage);

if (match.Groups[2].Success)

{

int endPage = int.Parse(match.Groups[2].Value);

for (int p = startPage; p <= endPage; p++)

pages.Add(p);

}

}

return pages.OrderBy(p => p).ToList();

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.RegularExpressions

' Answer questions with page citations and source verification

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("sample-legal-document.pdf")

Await pdf.Memorize()

Dim question As String = "What are the termination conditions in this agreement?"

' Request citations in query

Dim citationQuery As String = $"{question}

T: Include specific page citations in your answer using the format (Page X) or (Pages X-Y).

e information that appears in the document."

Dim answerWithCitations As String = Await pdf.Query(citationQuery)

Console.WriteLine("Question: " & question)

Console.WriteLine(vbCrLf & "Answer with Citations:")

Console.WriteLine(answerWithCitations)

' Extract cited page numbers using regex

Dim citedPages = ExtractCitedPages(answerWithCitations)

Console.WriteLine(vbCrLf & "Cited pages: " & String.Join(", ", citedPages))

' Verify citations with page excerpts

Console.WriteLine(vbCrLf & "=== Source Verification ===")

For Each pageNum As Integer In citedPages.Take(3)

If pageNum <= pdf.PageCount AndAlso pageNum > 0 Then

Dim pageText As String = pdf.Pages(pageNum - 1).Text

Dim excerpt As String = If(pageText.Length > 200, pageText.Substring(0, 200) & "...", pageText)

Console.WriteLine(vbCrLf & "Page " & pageNum & " excerpt:" & vbCrLf & excerpt)

End If

Next

' Extract page numbers from citation format (Page X) or (Pages X-Y)

Function ExtractCitedPages(ByVal text As String) As List(Of Integer)

Dim pages = New HashSet(Of Integer)()

Dim matches = Regex.Matches(text, "\((Pages?)\s*(\d+)(?:\s*-\s*(\d+))?\)", RegexOptions.IgnoreCase)

For Each match As Match In matches

Dim startPage As Integer = Integer.Parse(match.Groups(2).Value)

pages.Add(startPage)

If match.Groups(3).Success Then

Dim endPage As Integer = Integer.Parse(match.Groups(3).Value)

For p As Integer = startPage To endPage

pages.Add(p)

Next

End If

Next

Return pages.OrderBy(Function(p) p).ToList()

End FunctionWynik konsoli

Cytowania przekształcają odpowiedzi generowane przez AI z nieprzejrzystych wyjść w przejrzyste, weryfikowalne informacje. Użytkownicy mogą przeglądać materiały źródłowe, aby zweryfikować odpowiedzi i budować zaufanie do analizy wspomaganej przez AI.

Przetwarzanie Partii AI

Przetwarzanie Bibliotek Dokumentów na Dużą Skalę

Przetwarzanie dokumentów w przedsiębiorstwie często obejmuje setki tysięcy lub miliony PDF-ów. Podstawą skalowalnego przetwarzania partii jest równoległość. IronPDF jest bezpieczny dla wątków, umożliwiając równoczesne przetwarzanie PDF-ów bez zakłóceń.

Kod używa SemaphoreSlim z konfigurowalnym maxConcurrency do równoległego przetwarzania PDF-ów, wywołując pdf.Summarize() na każdym z nich przy jednoczesnym śledzeniu wyników w ConcurrentBag.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/batch-document-processing.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System;

using System.Collections.Concurrent;

using System.Text;

// Process multiple documents in parallel with rate limiting

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Configure parallel processing with rate limiting

int maxConcurrency = 3;

string inputFolder = "documents/";

string outputFolder = "summaries/";

Directory.CreateDirectory(outputFolder);

string[] pdfFiles = Directory.GetFiles(inputFolder, "*.pdf");

Console.WriteLine($"Processing {pdfFiles.Length} documents...\n");

var results = new ConcurrentBag<ProcessingResult>();

var semaphore = new SemaphoreSlim(maxConcurrency);

var tasks = pdfFiles.Select(async filePath =>

{

await semaphore.WaitAsync();

var result = new ProcessingResult { FilePath = filePath };

try

{

var stopwatch = System.Diagnostics.Stopwatch.StartNew();

var pdf = PdfDocument.FromFile(filePath);

string summary = await pdf.Summarize();

string outputPath = Path.Combine(outputFolder,

Path.GetFileNameWithoutExtension(filePath) + "-summary.txt");

await File.WriteAllTextAsync(outputPath, summary);

stopwatch.Stop();

result.Success = true;

result.ProcessingTime = stopwatch.Elapsed;

result.OutputPath = outputPath;

Console.WriteLine($"[OK] {Path.GetFileName(filePath)} ({stopwatch.ElapsedMilliseconds}ms)");

}

catch (Exception ex)

{

result.Success = false;

result.ErrorMessage = ex.Message;

Console.WriteLine($"[ERROR] {Path.GetFileName(filePath)}: {ex.Message}");

}

finally

{

semaphore.Release();

results.Add(result);

}

}).ToArray();

await Task.WhenAll(tasks);

// Generate processing report

var successful = results.Where(r => r.Success).ToList();

var failed = results.Where(r => !r.Success).ToList();

var report = new StringBuilder();

report.AppendLine("=== Batch Processing Report ===");

report.AppendLine($"Successful: {successful.Count}");

report.AppendLine($"Failed: {failed.Count}");

if (successful.Any())

{

var avgTime = TimeSpan.FromMilliseconds(successful.Average(r => r.ProcessingTime.TotalMilliseconds));