Procesamiento de PDF con IA en C#: Resuma, Extraiga y Analice Documentos con IronPDF

El procesamiento de PDF impulsado por IA en C# con IronPDF permite a los desarrolladores de .NET resumir documentos , extraer datos estructurados y crear sistemas de preguntas y respuestas directamente sobre flujos de trabajo de PDF existentes, utilizando el paquete IronPdf.Extensions.AI creado en Microsoft Semantic Kernel para conectarse sin problemas con Azure OpenAI y los modelos OpenAI . Tanto si está creando herramientas de descubrimiento legal, pipelines de análisis financiero o plataformas de inteligencia documental, IronPDF se encarga de la extracción de PDF y la preparación del contexto para que usted pueda centrarse en la lógica de la IA.

TL;DR: Guía de inicio rápido

Este tutorial explica cómo conectar IronPDF a servicios de inteligencia artificial para resumir documentos, extraer datos y realizar consultas inteligentes en C# .NET.

- A quién va dirigido: Desarrolladores .NET que crean aplicaciones de inteligencia documental: sistemas de descubrimiento legal, herramientas de análisis financiero, plataformas de revisión de cumplimiento o cualquier aplicación que necesite extraer significado de grandes volúmenes de documentos PDF.

- Qué harás: Resumen de un solo documento, extracción de datos JSON estructurados con esquemas personalizados, respuesta a preguntas sobre el contenido del documento, canalizaciones RAG para documentos largos y flujos de trabajo de procesamiento de IA por lotes en bibliotecas de documentos.

- Dónde se ejecuta: Cualquier entorno .NET 6+ con una clave Azure OpenAI u OpenAI API. La extensión AI se integra con Microsoft Semantic Kernel y se encarga automáticamente de la gestión de ventanas contextuales, la fragmentación y la orquestación.

- Cuándo utilizar este enfoque: Cuando su aplicación necesite procesar PDF más allá de la extracción de texto: comprender obligaciones contractuales, resumir artículos de investigación, extraer tablas financieras como datos estructurados o responder a preguntas de usuarios sobre el contenido de documentos a escala.

- Por qué es importante desde el punto de vista técnico: La extracción de texto en bruto pierde la estructura del documento: las tablas se colapsan, los diseños de varias columnas se rompen y las relaciones semánticas desaparecen. IronPDF prepara los documentos para el consumo de IA preservando la estructura y gestionando los límites de tokens, para que el modelo reciba una entrada limpia y bien organizada.

Resuma un PDF con unas pocas líneas de código:

-

Instala IronPDF con el Administrador de Paquetes NuGet

PM > Install-Package IronPdf -

Copie y ejecute este fragmento de código.

await IronPdf.AI.PdfAIEngine.Summarize("contract.pdf", "summary.txt", azureEndpoint, azureApiKey); -

Despliegue para probar en su entorno real

Comienza a usar IronPDF en tu proyecto hoy mismo con una prueba gratuita

Una vez que haya adquirido IronPDF o se haya suscrito a una versión de prueba de 30 días, añada su clave de licencia al inicio de su solicitud.

IronPdf.License.LicenseKey = "KEY";IronPdf.License.LicenseKey = "KEY";Imports IronPdf

IronPdf.License.LicenseKey = "KEY" Instalar con NuGet

Instalar con NuGet

Tabla de contenido

- La oportunidad AI + PDF

- Integración de IA integrada de IronPDF

- Resumen de documentos

- Extracción inteligente de datos

- Pregunta-respuesta sobre documentos

- Procesamiento de IA por lotes

- Casos de uso en el mundo real

- Solucion-de-problemas y soporte tecnico

La oportunidad AI + PDF

Por qué los PDF son la mayor fuente de datos sin explotar

Los PDF representan uno de los mayores repositorios de conocimiento empresarial estructurado en la empresa moderna. Los documentos profesionales -contratos, estados financieros, informes de cumplimiento, informes jurídicos y trabajos de investigación- se almacenan principalmente en formato PDF. Estos documentos contienen información empresarial esencial: cláusulas contractuales que definen obligaciones y responsabilidades, métricas financieras que impulsan las decisiones de inversión, requisitos normativos que garantizan el cumplimiento y resultados de investigaciones que orientan la estrategia.

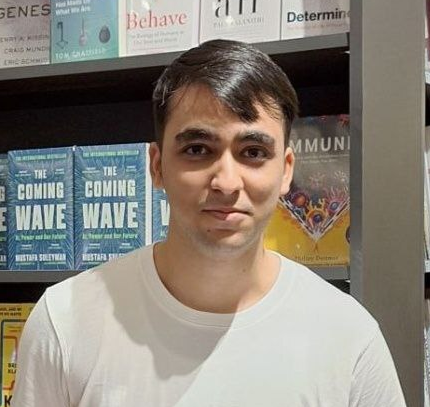

Sin embargo, los enfoques tradicionales del procesamiento de PDF se han visto muy limitados. Las herramientas básicas de extracción de texto pueden extraer caracteres en bruto de una página, pero pierden un contexto crucial: las estructuras de tablas se convierten en texto desordenado, los diseños de varias columnas pierden sentido y las relaciones semánticas entre secciones desaparecen.

El avance procede de la capacidad de la IA para comprender el contexto y la estructura. Los LLM modernos no solo ven palabras: comprenden la organización de los documentos, reconocen patrones como cláusulas contractuales o tablas financieras y pueden extraer el significado incluso de diseños complejos. Tanto el sistema de razonamiento unificado de GPT-5, con su enrutador en tiempo real, como las capacidades agenticas mejoradas de Claude Sonnet 4.5 demuestran tasas de alucinación significativamente reducidas en comparación con los modelos anteriores, lo que los hace fiables para el análisis profesional de documentos.

Cómo entienden los LLM la estructura de los documentos

Los grandes modelos lingüísticos aportan sofisticadas capacidades de procesamiento del lenguaje natural al análisis de PDF. La arquitectura híbrida de GPT-5 incluye múltiples submodelos (principal, mini, thinking, nano) con un enrutador en tiempo real que selecciona dinámicamente la variante óptima en función de la complejidad de la tarea: las preguntas sencillas se dirigen a los modelos más rápidos, mientras que las tareas de razonamiento complejas utilizan el modelo completo.

Claude Opus 4.6 destaca especialmente en las tareas agénticas de larga duración, con equipos de agentes que se coordinan directamente en trabajos segmentados y una ventana contextual de 1M de tokens que puede procesar bibliotecas de documentos enteras sin fragmentación.

Esta comprensión contextual permite a los LLM realizar tareas que requieren una verdadera comprensión. Al analizar un contrato, un LLM puede identificar no solo las cláusulas que contienen la palabra "rescisión", sino también comprender las condiciones específicas en las que se permite la rescisión, los requisitos de notificación y las responsabilidades derivadas. La base técnica que permite esta capacidad es la arquitectura de transformadores de los LLM modernos, con la ventana contextual de GPT-5, que admite hasta 272.000 tokens de entrada, y la ventana de tokens de 200.000 de Claude Sonnet 4.5, que proporciona una amplia cobertura de documentos.

Integración de IA integrada en IronPDF

Instalación de IronPDF y AI Extensions

Para empezar con el procesamiento de PDF basado en IA se requiere la biblioteca principal IronPDF, el paquete de extensiones de IA y las dependencias de Microsoft Semantic Kernel.

Instale IronPDF con el gestor de paquetes NuGet:

PM > Install-Package IronPdf

PM > Install-Package IronPdf.Extensions.AI

PM > Install-Package Microsoft.SemanticKernel

PM > Install-Package Microsoft.SemanticKernel.Plugins.MemoryPM > Install-Package IronPdf

PM > Install-Package IronPdf.Extensions.AI

PM > Install-Package Microsoft.SemanticKernel

PM > Install-Package Microsoft.SemanticKernel.Plugins.MemoryEstos paquetes funcionan conjuntamente para ofrecer una solución completa. IronPDF se encarga de todas las operaciones relacionadas con PDF -extracción de texto, representación de páginas, conversión de formatos-, mientras que la extensión AI gestiona la integración con modelos lingüísticos a través de Microsoft Semantic Kernel.

<NoWarn>$(NoWarn);SKEXP0001;SKEXP0010;SKEXP0050</NoWarn> a su PropertyGroup .csproj para suprimir las advertencias del compilador.Configurar su clave de API OpenAI/Azure

Antes de poder aprovechar las funciones de IA, es necesario configurar el acceso a un proveedor de servicios de IA. La extensión AI de IronPDF es compatible con OpenAI y Azure OpenAI. Azure OpenAI suele preferirse para aplicaciones empresariales porque ofrece funciones de seguridad mejoradas, certificaciones de cumplimiento y la capacidad de mantener los datos dentro de regiones geográficas específicas.

Para configurar Azure OpenAI, necesitará la URL del punto final de Azure, la clave de API y los nombres de implementación tanto para el chat como para incrustar modelos desde el portal de Azure.

Inicialización del motor de IA

La extensión AI de IronPDF utiliza Microsoft Semantic Kernel. Antes de utilizar cualquier función de IA, debe inicializar el núcleo con sus credenciales de Azure OpenAI y configurar el almacén de memoria para el procesamiento de documentos.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/configure-azure-credentials.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Initialize IronPDF AI with Azure OpenAI credentials

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel with Azure OpenAI

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

// Create memory store for document embeddings

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

// Initialize IronPDF AI

IronDocumentAI.Initialize(kernel, memory);

Console.WriteLine("IronPDF AI initialized successfully with Azure OpenAI");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Initialize IronPDF AI with Azure OpenAI credentials

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel with Azure OpenAI

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

' Create memory store for document embeddings

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

' Initialize IronPDF AI

IronDocumentAI.Initialize(kernel, memory)

Console.WriteLine("IronPDF AI initialized successfully with Azure OpenAI")La inicialización crea dos componentes clave:

- Kernel: Maneja las finalizaciones de chat y la generación de texto incrustado a través de Azure OpenAI

- Memoria: Almacena incrustaciones de documentos para operaciones de búsqueda y recuperación semántica

Una vez inicializado con IronDocumentAI.Initialize(), puede utilizar funciones de IA en toda su aplicación. Para las aplicaciones de producción, se recomienda encarecidamente almacenar las credenciales en variables de entorno o en Azure Key Vault.

Cómo prepara IronPDF los PDF para el contexto de la IA

Uno de los aspectos más complicados del procesamiento de PDF con IA es preparar los documentos para que los consuman los modelos lingüísticos. Aunque GPT-5 admite hasta 272.000 tokens de entrada y Claude Opus 4.6 ofrece ahora una ventana contextual de 1 millón de tokens, un único contrato legal o informe financiero puede superar fácilmente los límites de los modelos anteriores.

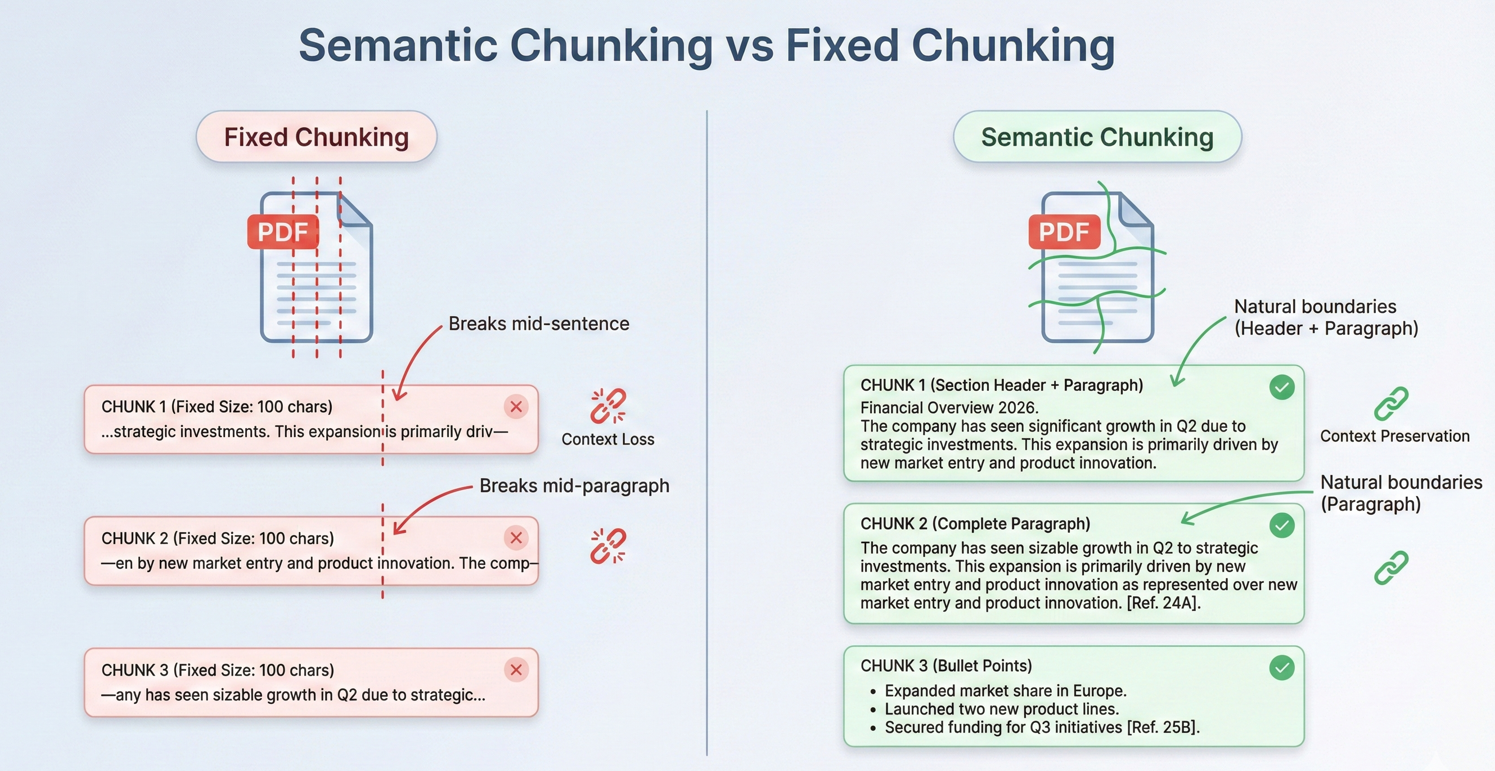

La extensión de IA de IronPDF gestiona esta complejidad mediante la preparación inteligente de documentos. Cuando se llama a un método AI, IronPDF extrae primero el texto del PDF conservando la información estructural: identificación de párrafos, conservación de estructuras de tablas y mantenimiento de las relaciones entre secciones.

Para los documentos que superan los límites de contexto, IronPDF implementa la fragmentación estratégica en puntos de ruptura semántica, es decir, divisiones naturales en la estructura del documento como encabezados de sección, saltos de página o límites de párrafo.

Resumen de documentos

Resúmenes de documentos individuales

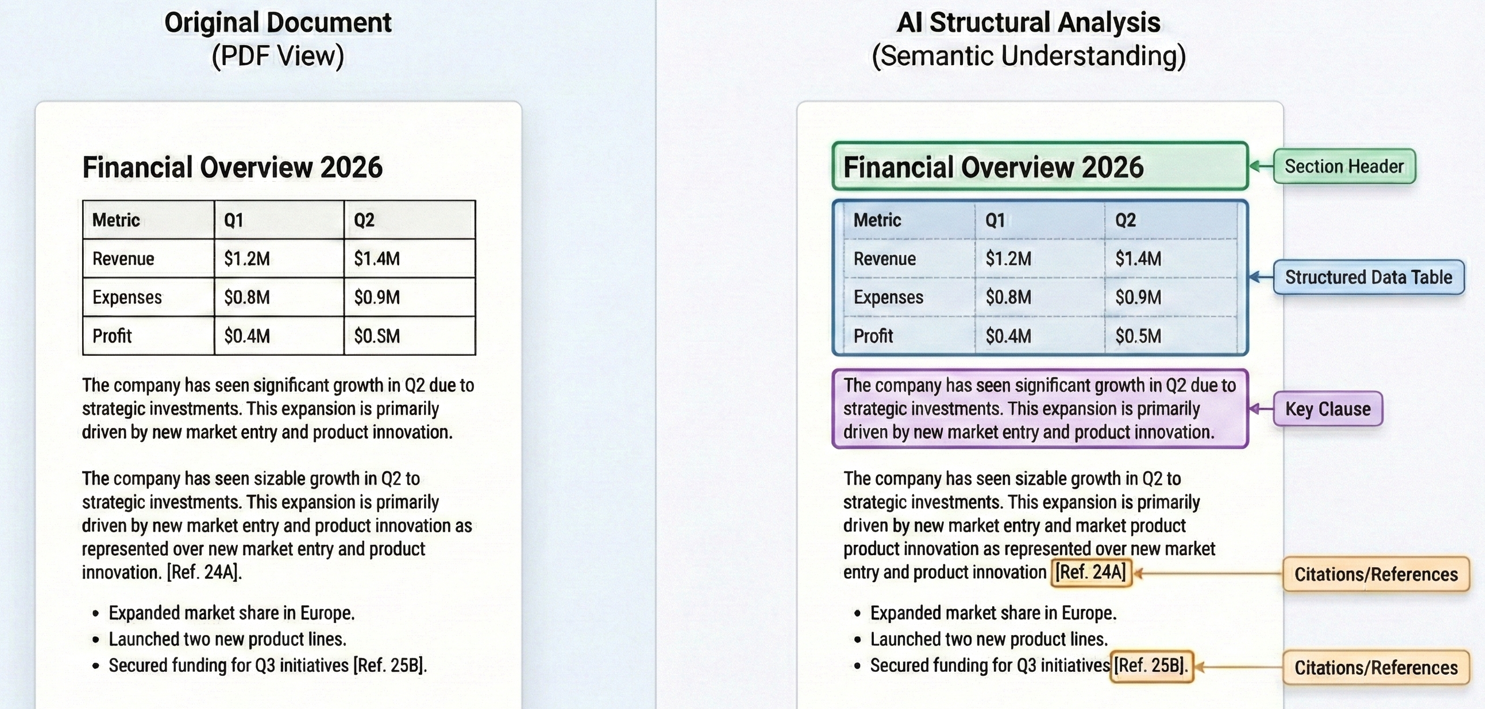

El resumen de documentos ofrece un valor inmediato al condensar documentos extensos en información digerible. El método Summarize maneja todo el flujo de trabajo: extraer texto, prepararlo para el consumo de IA, solicitar un resumen del modelo de lenguaje y guardar los resultados.

Entrada

El código carga un PDF usando PdfDocument.FromFile() y llama a pdf.Summarize() para generar un resumen conciso, luego guarda el resultado en un archivo de texto.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/single-document-summary.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Summarize a PDF document using IronPDF AI

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Load and summarize PDF

var pdf = PdfDocument.FromFile("sample-report.pdf");

string summary = await pdf.Summarize();

Console.WriteLine("Document Summary:");

Console.WriteLine(summary);

File.WriteAllText("report-summary.txt", summary);

Console.WriteLine("\nSummary saved to report-summary.txt");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Summarize a PDF document using IronPDF AI

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

' Load and summarize PDF

Dim pdf = PdfDocument.FromFile("sample-report.pdf")

Dim summary As String = Await pdf.Summarize()

Console.WriteLine("Document Summary:")

Console.WriteLine(summary)

File.WriteAllText("report-summary.txt", summary)

Console.WriteLine(vbCrLf & "Summary saved to report-summary.txt")Salida de consola

El proceso de resumen utiliza sofisticadas instrucciones para garantizar resultados de alta calidad. Tanto GPT-5 como Claude Sonnet 4.5 en 2026 incorporan funciones de seguimiento de instrucciones significativamente mejoradas, lo que garantiza que los resúmenes capten la información esencial sin dejar de ser concisos y legibles.

Para obtener una explicación más detallada de las técnicas de resumen de documentos y las opciones avanzadas, consulte nuestra guía práctica.

Síntesis de documentos múltiples

Muchas situaciones del mundo real requieren sintetizar información de varios documentos. Un equipo jurídico puede necesitar identificar cláusulas comunes en una cartera de contratos, o un analista financiero puede querer comparar métricas en informes trimestrales.

El enfoque de la síntesis de documentos múltiples consiste en procesar cada documento por separado para extraer la información clave y, a continuación, agregar estos datos para la síntesis final.

Este ejemplo itera a través de múltiples PDF, llamando a pdf.Summarize() en cada uno, luego usa pdf.Query() con los resúmenes combinados para generar una síntesis unificada.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/multi-document-synthesis.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Synthesize insights across multiple related documents (e.g., quarterly reports into annual summary)

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Define documents to synthesize

string[] documentPaths = {

"Q1-report.pdf",

"Q2-report.pdf",

"Q3-report.pdf",

"Q4-report.pdf"

};

var documentSummaries = new List<string>();

// Summarize each document

foreach (string path in documentPaths)

{

var pdf = PdfDocument.FromFile(path);

string summary = await pdf.Summarize();

documentSummaries.Add($"=== {Path.GetFileName(path)} ===\n{summary}");

Console.WriteLine($"Processed: {path}");

}

// Combine and synthesize across all documents

string combinedSummaries = string.Join("\n\n", documentSummaries);

var synthesisDoc = PdfDocument.FromFile(documentPaths[0]);

string synthesisQuery = @"Based on the quarterly summaries below, provide an annual synthesis:

ll trends across quarters

chievements and challenges

over-year patterns

s:

inedSummaries;

string synthesis = await synthesisDoc.Query(synthesisQuery);

Console.WriteLine("\n=== Annual Synthesis ===");

Console.WriteLine(synthesis);

File.WriteAllText("annual-synthesis.txt", synthesis);Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.IO

' Synthesize insights across multiple related documents (e.g., quarterly reports into annual summary)

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

' Define documents to synthesize

Dim documentPaths As String() = {

"Q1-report.pdf",

"Q2-report.pdf",

"Q3-report.pdf",

"Q4-report.pdf"

}

Dim documentSummaries = New List(Of String)()

' Summarize each document

For Each path As String In documentPaths

Dim pdf = PdfDocument.FromFile(path)

Dim summary As String = Await pdf.Summarize()

documentSummaries.Add($"=== {Path.GetFileName(path)} ==={vbCrLf}{summary}")

Console.WriteLine($"Processed: {path}")

Next

' Combine and synthesize across all documents

Dim combinedSummaries As String = String.Join(vbCrLf & vbCrLf, documentSummaries)

Dim synthesisDoc = PdfDocument.FromFile(documentPaths(0))

Dim synthesisQuery As String = "Based on the quarterly summaries below, provide an annual synthesis:" & vbCrLf &

"Overall trends across quarters" & vbCrLf &

"Key achievements and challenges" & vbCrLf &

"Year-over-year patterns" & vbCrLf & vbCrLf &

combinedSummaries

Dim synthesis As String = Await synthesisDoc.Query(synthesisQuery)

Console.WriteLine(vbCrLf & "=== Annual Synthesis ===")

Console.WriteLine(synthesis)

File.WriteAllText("annual-synthesis.txt", synthesis)Este patrón se adapta con eficacia a grandes conjuntos de documentos. Al procesar los documentos en paralelo y gestionar los resultados intermedios, se pueden analizar cientos o miles de documentos manteniendo una síntesis coherente.

Generación de resúmenes ejecutivos

Los resúmenes ejecutivos requieren un enfoque diferente al de los resúmenes estándar. En lugar de limitarse a condensar el contenido, un resumen ejecutivo debe identificar la información más crítica para la empresa, destacar las decisiones o recomendaciones clave y presentar las conclusiones en un formato adecuado para su revisión por parte de los directivos.

El código utiliza pdf.Query() con una instrucción estructurada que solicita decisiones clave, hallazgos críticos, impacto financiero y evaluación de riesgos en lenguaje comercial.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/executive-summary.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Generate executive summary from strategic documents for C-suite leadership

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("strategic-plan.pdf");

string executiveQuery = @"Create an executive summary for C-suite leadership. Include:

cisions Required:**

ny decisions needing executive approval

al Findings:**

5 most important findings (bullet points)

ial Impact:**

e/cost implications if mentioned

ssessment:**

riority risks identified

ended Actions:**

ate next steps

er 500 words. Use business language appropriate for board presentation.";

string executiveSummary = await pdf.Query(executiveQuery);

File.WriteAllText("executive-summary.txt", executiveSummary);

Console.WriteLine("Executive summary saved to executive-summary.txt");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Generate executive summary from strategic documents for C-suite leadership

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("strategic-plan.pdf")

Dim executiveQuery As String = "Create an executive summary for C-suite leadership. Include:

cisions Required:**

ny decisions needing executive approval

al Findings:**

5 most important findings (bullet points)

ial Impact:**

e/cost implications if mentioned

ssessment:**

riority risks identified

ended Actions:**

ate next steps

er 500 words. Use business language appropriate for board presentation."

Dim executiveSummary As String = Await pdf.Query(executiveQuery)

File.WriteAllText("executive-summary.txt", executiveSummary)

Console.WriteLine("Executive summary saved to executive-summary.txt")El resumen ejecutivo resultante da prioridad a la información práctica sobre la cobertura exhaustiva, ofreciendo exactamente lo que necesitan los responsables de la toma de decisiones sin abrumar con detalles.

Extracción inteligente de datos

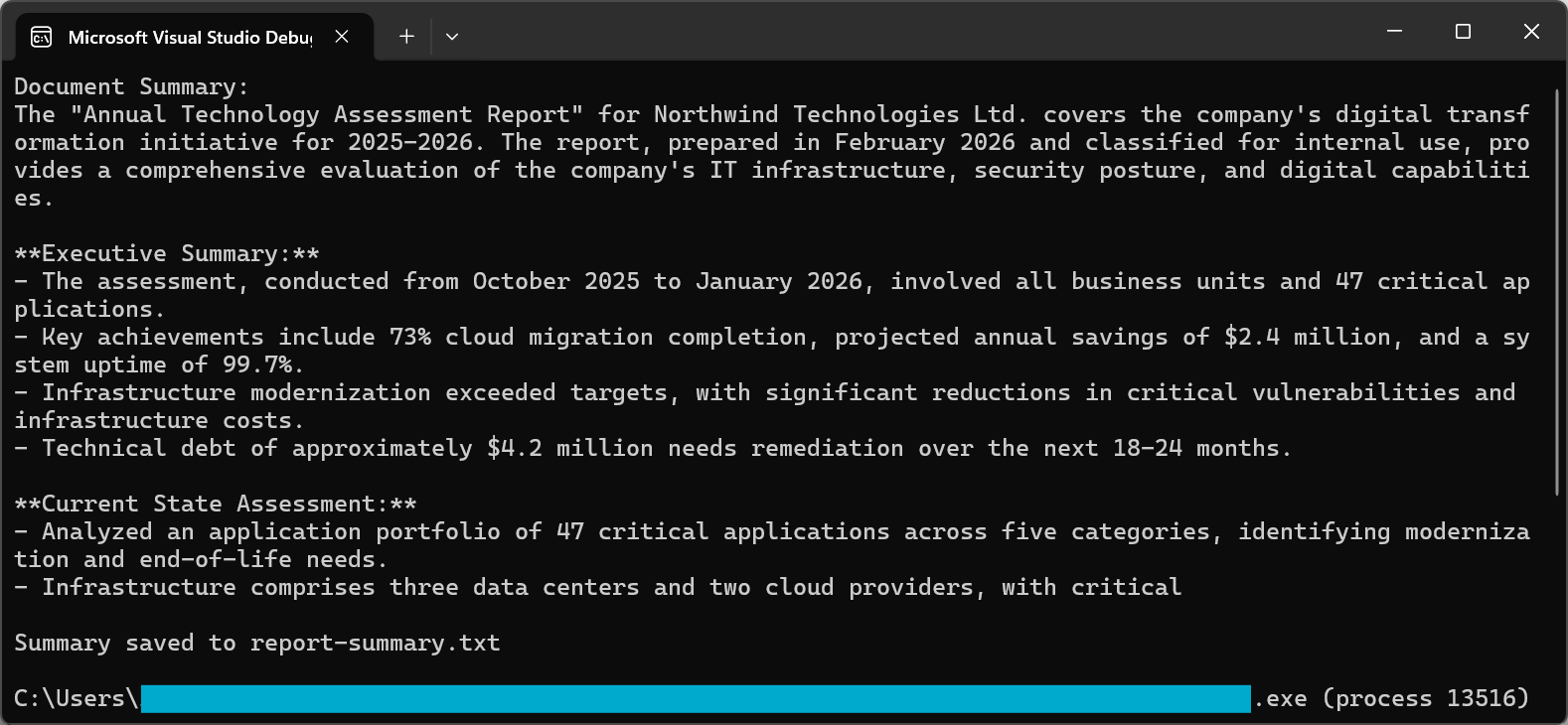

Extracción de datos estructurados a JSON

Una de las aplicaciones más potentes del procesamiento de PDF con IA es la extracción de datos estructurados de documentos no estructurados. La clave del éxito de la extracción estructurada en 2026 es utilizar esquemas JSON con modos de salida estructurados. GPT-5 introduce salidas estructuradas mejoradas, mientras que Claude Sonnet 4.5 ofrece una orquestación de herramientas mejorada para una extracción de datos fiable.

Entrada

El código llama a pdf.Query() con un mensaje de esquema JSON y luego usa JsonSerializer.Deserialize() para analizar y validar los datos de la factura extraídos.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/extract-invoice-json.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Extract structured invoice data as JSON from PDF

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("sample-invoice.pdf");

// Define JSON schema for extraction

string extractionQuery = @"Extract invoice data and return as JSON with this exact structure:

voiceNumber"": ""string"",

voiceDate"": ""YYYY-MM-DD"",

eDate"": ""YYYY-MM-DD"",

ndor"": {

""name"": ""string"",

""address"": ""string"",

""taxId"": ""string or null""

stomer"": {

""name"": ""string"",

""address"": ""string""

neItems"": [

{

""description"": ""string"",

""quantity"": number,

""unitPrice"": number,

""total"": number

}

btotal"": number,

xRate"": number,

xAmount"": number,

tal"": number,

rrency"": ""string""

NLY valid JSON, no additional text.";

string jsonResponse = await pdf.Query(extractionQuery);

// Parse and save JSON

try

{

var invoiceData = JsonSerializer.Deserialize<JsonElement>(jsonResponse);

string formattedJson = JsonSerializer.Serialize(invoiceData, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Extracted Invoice Data:");

Console.WriteLine(formattedJson);

File.WriteAllText("invoice-data.json", formattedJson);

}

catch (JsonException)

{

Console.WriteLine("Unable to parse JSON response");

File.WriteAllText("invoice-raw-response.txt", jsonResponse);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Extract structured invoice data as JSON from PDF

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("sample-invoice.pdf")

' Define JSON schema for extraction

Dim extractionQuery As String = "Extract invoice data and return as JSON with this exact structure:

voiceNumber"": ""string"",

voiceDate"": ""YYYY-MM-DD"",

eDate"": ""YYYY-MM-DD"",

ndor"": {

""name"": ""string"",

""address"": ""string"",

""taxId"": ""string or null""

stomer"": {

""name"": ""string"",

""address"": ""string""

neItems"": [

{

""description"": ""string"",

""quantity"": number,

""unitPrice"": number,

""total"": number

}

btotal"": number,

xRate"": number,

xAmount"": number,

tal"": number,

rrency"": ""string""

NLY valid JSON, no additional text."

Dim jsonResponse As String = Await pdf.QueryAsync(extractionQuery)

' Parse and save JSON

Try

Dim invoiceData = JsonSerializer.Deserialize(Of JsonElement)(jsonResponse)

Dim formattedJson As String = JsonSerializer.Serialize(invoiceData, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Extracted Invoice Data:")

Console.WriteLine(formattedJson)

File.WriteAllText("invoice-data.json", formattedJson)

Catch ex As JsonException

Console.WriteLine("Unable to parse JSON response")

File.WriteAllText("invoice-raw-response.txt", jsonResponse)

End TryCaptura de pantalla parcial del archivo JSON generado

Los modelos modernos de IA en 2026 admiten modos de salida estructurados que garantizan respuestas JSON válidas que se ajustan a los esquemas proporcionados. Esto elimina la necesidad de una compleja gestión de errores en torno a respuestas malformadas.

Identificación de cláusulas contractuales

Los contratos legales contienen tipos específicos de cláusulas que revisten especial importancia: cláusulas de rescisión, limitaciones de responsabilidad, requisitos de indemnización, cesiones de propiedad intelectual y obligaciones de confidencialidad. La identificación de cláusulas mediante IA automatiza este análisis y mantiene un alto nivel de precisión.

Este ejemplo utiliza pdf.Query() con un esquema JSON centrado en cláusulas para extraer el tipo de contrato, las partes, las fechas críticas y cláusulas individuales con niveles de riesgo.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/contract-clause-analysis.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Analyze contract clauses and identify key terms, risks, and critical dates

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("contract.pdf");

// Define JSON schema for contract analysis

string clauseQuery = @"Analyze this contract and identify key clauses. Return JSON:

ntractType"": ""string"",

rties"": [""string""],

fectiveDate"": ""string"",

auses"": [

{

""type"": ""Termination|Liability|Indemnification|Confidentiality|IP|Payment|Warranty|Other"",

""title"": ""string"",

""summary"": ""string"",

""riskLevel"": ""Low|Medium|High"",

""keyTerms"": [""string""]

}

iticalDates"": [

{

""description"": ""string"",

""date"": ""string""

}

erallRiskAssessment"": ""Low|Medium|High"",

commendations"": [""string""]

: termination rights, liability caps, indemnification, IP ownership, confidentiality, payment terms.

NLY valid JSON.";

string analysisJson = await pdf.Query(clauseQuery);

try

{

var analysis = JsonSerializer.Deserialize<JsonElement>(analysisJson);

string formatted = JsonSerializer.Serialize(analysis, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Contract Clause Analysis:");

Console.WriteLine(formatted);

File.WriteAllText("contract-analysis.json", formatted);

// Display high-risk clauses

Console.WriteLine("\n=== High Risk Clauses ===");

foreach (var clause in analysis.GetProperty("clauses").EnumerateArray())

{

if (clause.GetProperty("riskLevel").GetString() == "High")

{

Console.WriteLine($"- {clause.GetProperty("type")}: {clause.GetProperty("summary")}");

}

}

}

catch (JsonException)

{

Console.WriteLine("Unable to parse contract analysis");

File.WriteAllText("contract-analysis-raw.txt", analysisJson);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Analyze contract clauses and identify key terms, risks, and critical dates

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("contract.pdf")

' Define JSON schema for contract analysis

Dim clauseQuery As String = "Analyze this contract and identify key clauses. Return JSON:

ntractType"": ""string"",

rties"": [""string""],

fectiveDate"": ""string"",

auses"": [

{

""type"": ""Termination|Liability|Indemnification|Confidentiality|IP|Payment|Warranty|Other"",

""title"": ""string"",

""summary"": ""string"",

""riskLevel"": ""Low|Medium|High"",

""keyTerms"": [""string""]

}

iticalDates"": [

{

""description"": ""string"",

""date"": ""string""

}

erallRiskAssessment"": ""Low|Medium|High"",

commendations"": [""string""]

: termination rights, liability caps, indemnification, IP ownership, confidentiality, payment terms.

NLY valid JSON."

Dim analysisJson As String = Await pdf.Query(clauseQuery)

Try

Dim analysis = JsonSerializer.Deserialize(Of JsonElement)(analysisJson)

Dim formatted As String = JsonSerializer.Serialize(analysis, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Contract Clause Analysis:")

Console.WriteLine(formatted)

File.WriteAllText("contract-analysis.json", formatted)

' Display high-risk clauses

Console.WriteLine(vbCrLf & "=== High Risk Clauses ===")

For Each clause In analysis.GetProperty("clauses").EnumerateArray()

If clause.GetProperty("riskLevel").GetString() = "High" Then

Console.WriteLine($"- {clause.GetProperty("type")}: {clause.GetProperty("summary")}")

End If

Next

Catch ex As JsonException

Console.WriteLine("Unable to parse contract analysis")

File.WriteAllText("contract-analysis-raw.txt", analysisJson)

End TryEsta capacidad transforma la revisión de contratos de un proceso secuencial y manual a un flujo de trabajo automatizado y escalable. Los equipos jurídicos pueden identificar rápidamente las disposiciones de alto riesgo en cientos de contratos.

Interpretación de datos financieros

Los documentos financieros contienen datos cuantitativos críticos integrados en narraciones y tablas complejas. El análisis sintáctico basado en IA destaca en documentos financieros porque entiende el contexto: distingue entre resultados históricos y proyecciones futuras, identifica si las cifras están en miles o en millones y comprende las relaciones entre las distintas métricas.

El código utiliza pdf.Query() con un esquema JSON financiero para extraer datos del estado de resultados, métricas del balance y orientación futura en una salida estructurada.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/financial-data-extraction.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Extract financial metrics from annual reports and earnings documents

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("annual-report.pdf");

// Define JSON schema for financial extraction (numbers in millions)

string financialQuery = @"Extract financial metrics from this document. Return JSON:

portPeriod"": ""string"",

mpany"": ""string"",

rrency"": ""string"",

comeStatement"": {

""revenue"": number,

""costOfRevenue"": number,

""grossProfit"": number,

""operatingExpenses"": number,

""operatingIncome"": number,

""netIncome"": number,

""eps"": number

lanceSheet"": {

""totalAssets"": number,

""totalLiabilities"": number,

""shareholdersEquity"": number,

""cash"": number,

""totalDebt"": number

yMetrics"": {

""revenueGrowthYoY"": ""string"",

""grossMargin"": ""string"",

""operatingMargin"": ""string"",

""netMargin"": ""string"",

""debtToEquity"": number

idance"": {

""nextQuarterRevenue"": ""string"",

""fullYearRevenue"": ""string"",

""notes"": ""string""

for unavailable data. Numbers in millions unless stated.

NLY valid JSON.";

string financialJson = await pdf.Query(financialQuery);

try

{

var financials = JsonSerializer.Deserialize<JsonElement>(financialJson);

string formatted = JsonSerializer.Serialize(financials, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Extracted Financial Data:");

Console.WriteLine(formatted);

File.WriteAllText("financial-data.json", formatted);

}

catch (JsonException)

{

Console.WriteLine("Unable to parse financial data");

File.WriteAllText("financial-raw.txt", financialJson);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Extract financial metrics from annual reports and earnings documents

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("annual-report.pdf")

' Define JSON schema for financial extraction (numbers in millions)

Dim financialQuery As String = "Extract financial metrics from this document. Return JSON:

portPeriod"": ""string"",

mpany"": ""string"",

rrency"": ""string"",

comeStatement"": {

""revenue"": number,

""costOfRevenue"": number,

""grossProfit"": number,

""operatingExpenses"": number,

""operatingIncome"": number,

""netIncome"": number,

""eps"": number

lanceSheet"": {

""totalAssets"": number,

""totalLiabilities"": number,

""shareholdersEquity"": number,

""cash"": number,

""totalDebt"": number

yMetrics"": {

""revenueGrowthYoY"": ""string"",

""grossMargin"": ""string"",

""operatingMargin"": ""string"",

""netMargin"": ""string"",

""debtToEquity"": number

idance"": {

""nextQuarterRevenue"": ""string"",

""fullYearRevenue"": ""string"",

""notes"": ""string""

for unavailable data. Numbers in millions unless stated.

NLY valid JSON."

Dim financialJson As String = Await pdf.Query(financialQuery)

Try

Dim financials = JsonSerializer.Deserialize(Of JsonElement)(financialJson)

Dim formatted As String = JsonSerializer.Serialize(financials, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Extracted Financial Data:")

Console.WriteLine(formatted)

File.WriteAllText("financial-data.json", formatted)

Catch ex As JsonException

Console.WriteLine("Unable to parse financial data")

File.WriteAllText("financial-raw.txt", financialJson)

End TryLos datos estructurados extraídos pueden introducirse directamente en modelos financieros, bases de datos de series temporales o plataformas analíticas, lo que permite un seguimiento automatizado de las métricas a lo largo de los periodos de información.

Propuestas de extracción personalizadas

Muchas organizaciones tienen requisitos de extracción únicos basados en su dominio específico, formatos de documentos o procesos empresariales. La integración de IA de IronPDF es totalmente compatible con indicaciones de extracción personalizadas, lo que le permite definir exactamente qué información debe extraerse y cómo debe estructurarse.

Este ejemplo demuestra pdf.Query() con una metodología de extracción de esquemas centrada en la investigación, hallazgos clave con niveles de confianza y limitaciones de artículos académicos.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/custom-research-extraction.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.Json;

// Extract structured research metadata from academic papers

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("research-paper.pdf");

// Define JSON schema for research paper extraction

string researchQuery = @"Extract structured information from this research paper. Return JSON:

tle"": ""string"",

thors"": [""string""],

stitution"": ""string"",

blicationDate"": ""string"",

stract"": ""string"",

searchQuestion"": ""string"",

thodology"": {

""type"": ""Quantitative|Qualitative|Mixed Methods"",

""approach"": ""string"",

""sampleSize"": ""string"",

""dataCollection"": ""string""

yFindings"": [

{

""finding"": ""string"",

""significance"": ""string"",

""confidence"": ""High|Medium|Low""

}

mitations"": [""string""],

tureWork"": [""string""],

ywords"": [""string""]

extracting verifiable claims and noting uncertainty.

NLY valid JSON.";

string extractionResult = await pdf.Query(researchQuery);

try

{

var research = JsonSerializer.Deserialize<JsonElement>(extractionResult);

string formatted = JsonSerializer.Serialize(research, new JsonSerializerOptions { WriteIndented = true });

Console.WriteLine("Research Paper Extraction:");

Console.WriteLine(formatted);

File.WriteAllText("research-extraction.json", formatted);

// Display key findings with confidence levels

Console.WriteLine("\n=== Key Findings ===");

foreach (var finding in research.GetProperty("keyFindings").EnumerateArray())

{

string confidence = finding.GetProperty("confidence").GetString() ?? "Unknown";

Console.WriteLine($"[{confidence}] {finding.GetProperty("finding")}");

}

}

catch (JsonException)

{

Console.WriteLine("Unable to parse research extraction");

File.WriteAllText("research-raw.txt", extractionResult);

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.Json

' Extract structured research metadata from academic papers

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("research-paper.pdf")

' Define JSON schema for research paper extraction

Dim researchQuery As String = "Extract structured information from this research paper. Return JSON:

tle"": ""string"",

thors"": [""string""],

stitution"": ""string"",

blicationDate"": ""string"",

stract"": ""string"",

searchQuestion"": ""string"",

thodology"": {

""type"": ""Quantitative|Qualitative|Mixed Methods"",

""approach"": ""string"",

""sampleSize"": ""string"",

""dataCollection"": ""string""

yFindings"": [

{

""finding"": ""string"",

""significance"": ""string"",

""confidence"": ""High|Medium|Low""

}

mitations"": [""string""],

tureWork"": [""string""],

ywords"": [""string""]

extracting verifiable claims and noting uncertainty.

NLY valid JSON."

Dim extractionResult As String = Await pdf.Query(researchQuery)

Try

Dim research = JsonSerializer.Deserialize(Of JsonElement)(extractionResult)

Dim formatted As String = JsonSerializer.Serialize(research, New JsonSerializerOptions With {.WriteIndented = True})

Console.WriteLine("Research Paper Extraction:")

Console.WriteLine(formatted)

File.WriteAllText("research-extraction.json", formatted)

' Display key findings with confidence levels

Console.WriteLine(vbCrLf & "=== Key Findings ===")

For Each finding In research.GetProperty("keyFindings").EnumerateArray()

Dim confidence As String = finding.GetProperty("confidence").GetString() OrElse "Unknown"

Console.WriteLine($"[{confidence}] {finding.GetProperty("finding")}")

Next

Catch ex As JsonException

Console.WriteLine("Unable to parse research extraction")

File.WriteAllText("research-raw.txt", extractionResult)

End TryLas instrucciones personalizadas transforman la extracción asistida por IA de una herramienta genérica en una solución especializada adaptada a sus necesidades específicas.

Respuesta a preguntas sobre documentos

Creación de un sistema de preguntas y respuestas en PDF

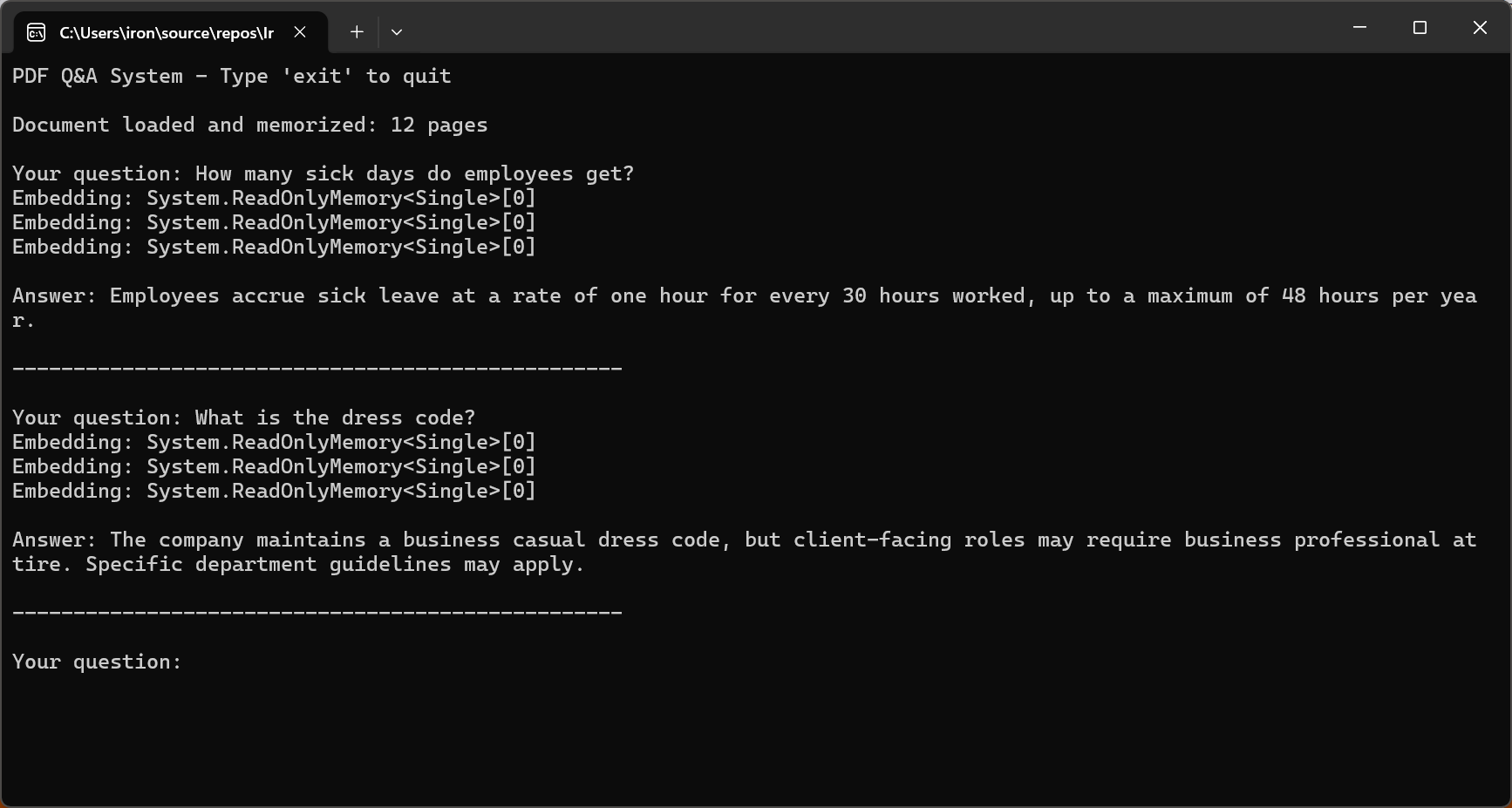

Los sistemas de respuesta a preguntas permiten a los usuarios interactuar con documentos PDF de forma conversacional, formulando preguntas en lenguaje natural y recibiendo respuestas precisas y contextuales. El patrón básico consiste en extraer texto del PDF, combinarlo con la pregunta del usuario en un prompt y solicitar una respuesta a la IA.

Entrada

El código llama a pdf.Memorize() para indexar el documento para la búsqueda semántica, luego ingresa a un bucle interactivo usando pdf.Query() para responder las preguntas del usuario.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/pdf-question-answering.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Interactive Q&A system for querying PDF documents

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("sample-legal-document.pdf");

// Memorize document to enable persistent querying

await pdf.Memorize();

Console.WriteLine("PDF Q&A System - Type 'exit' to quit\n");

Console.WriteLine($"Document loaded and memorized: {pdf.PageCount} pages\n");

// Interactive Q&A loop

while (true)

{

Console.Write("Your question: ");

string? question = Console.ReadLine();

if (string.IsNullOrWhiteSpace(question) || question.ToLower() == "exit")

break;

string answer = await pdf.Query(question);

Console.WriteLine($"\nAnswer: {answer}\n");

Console.WriteLine(new string('-', 50) + "\n");

}

Console.WriteLine("Q&A session ended.");Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

' Interactive Q&A system for querying PDF documents

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("sample-legal-document.pdf")

' Memorize document to enable persistent querying

Await pdf.Memorize()

Console.WriteLine("PDF Q&A System - Type 'exit' to quit" & vbCrLf)

Console.WriteLine($"Document loaded and memorized: {pdf.PageCount} pages" & vbCrLf)

' Interactive Q&A loop

While True

Console.Write("Your question: ")

Dim question As String = Console.ReadLine()

If String.IsNullOrWhiteSpace(question) OrElse question.ToLower() = "exit" Then

Exit While

End If

Dim answer As String = Await pdf.Query(question)

Console.WriteLine($"{vbCrLf}Answer: {answer}{vbCrLf}")

Console.WriteLine(New String("-"c, 50) & vbCrLf)

End While

Console.WriteLine("Q&A session ended.")Salida de consola

La clave para que las preguntas y respuestas sean eficaces en 2026 es obligar a la IA a responder basándose únicamente en el contenido del documento. El método de entrenamiento "safe completions" de GPT-5 y la alineación mejorada de Claude Sonnet 4.5 reducen sustancialmente las tasas de alucinación.

Corte de documentos largos para ventanas contextuales

La mayoría de los documentos del mundo real superan las ventanas contextuales de AI. Para procesar estos documentos es esencial contar con estrategias de fragmentación eficaces. La fragmentación consiste en dividir los documentos en segmentos lo suficientemente pequeños como para que quepan en ventanas contextuales, manteniendo al mismo tiempo la coherencia semántica.

Este código itera a través de pdf.Pages, creando objetos DocumentChunk con maxChunkTokens y overlapTokens configurables para la continuidad del contexto.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/semantic-document-chunking.csusing IronPdf;

// Split long documents into overlapping chunks for RAG systems

var pdf = PdfDocument.FromFile("long-document.pdf");

// Chunking configuration

int maxChunkTokens = 4000; // Leave room for prompts and responses

int overlapTokens = 200; // Overlap for context continuity

int approxCharsPerToken = 4; // Rough estimate for tokenization

int maxChunkChars = maxChunkTokens * approxCharsPerToken;

int overlapChars = overlapTokens * approxCharsPerToken;

var chunks = new List<DocumentChunk>();

var currentChunk = new System.Text.StringBuilder();

int chunkStartPage = 1;

int currentPage = 1;

for (int i = 0; i < pdf.PageCount; i++)

{

string pageText = pdf.Pages[i].Text;

currentPage = i + 1;

if (currentChunk.Length + pageText.Length > maxChunkChars && currentChunk.Length > 0)

{

chunks.Add(new DocumentChunk

{

Text = currentChunk.ToString(),

StartPage = chunkStartPage,

EndPage = currentPage - 1,

ChunkIndex = chunks.Count

});

// Create overlap with previous chunk for continuity

string overlap = currentChunk.Length > overlapChars

? currentChunk.ToString().Substring(currentChunk.Length - overlapChars)

: currentChunk.ToString();

currentChunk.Clear();

currentChunk.Append(overlap);

chunkStartPage = currentPage - 1;

}

currentChunk.AppendLine($"\n--- Page {currentPage} ---\n");

currentChunk.Append(pageText);

}

if (currentChunk.Length > 0)

{

chunks.Add(new DocumentChunk

{

Text = currentChunk.ToString(),

StartPage = chunkStartPage,

EndPage = currentPage,

ChunkIndex = chunks.Count

});

}

Console.WriteLine($"Document chunked into {chunks.Count} segments");

foreach (var chunk in chunks)

{

Console.WriteLine($" Chunk {chunk.ChunkIndex + 1}: Pages {chunk.StartPage}-{chunk.EndPage} ({chunk.Text.Length} chars)");

}

// Save chunk metadata for RAG indexing

File.WriteAllText("chunks-metadata.json", System.Text.Json.JsonSerializer.Serialize(

chunks.Select(c => new { c.ChunkIndex, c.StartPage, c.EndPage, Length = c.Text.Length }),

new System.Text.Json.JsonSerializerOptions { WriteIndented = true }

));

ic class DocumentChunk

public string Text { get; set; } = "";

public int StartPage { get; set; }

public int EndPage { get; set; }

public int ChunkIndex { get; set; }Imports IronPdf

Imports System.IO

Imports System.Text

Imports System.Text.Json

' Split long documents into overlapping chunks for RAG systems

Dim pdf = PdfDocument.FromFile("long-document.pdf")

' Chunking configuration

Dim maxChunkTokens As Integer = 4000 ' Leave room for prompts and responses

Dim overlapTokens As Integer = 200 ' Overlap for context continuity

Dim approxCharsPerToken As Integer = 4 ' Rough estimate for tokenization

Dim maxChunkChars As Integer = maxChunkTokens * approxCharsPerToken

Dim overlapChars As Integer = overlapTokens * approxCharsPerToken

Dim chunks As New List(Of DocumentChunk)()

Dim currentChunk As New StringBuilder()

Dim chunkStartPage As Integer = 1

Dim currentPage As Integer = 1

For i As Integer = 0 To pdf.PageCount - 1

Dim pageText As String = pdf.Pages(i).Text

currentPage = i + 1

If currentChunk.Length + pageText.Length > maxChunkChars AndAlso currentChunk.Length > 0 Then

chunks.Add(New DocumentChunk With {

.Text = currentChunk.ToString(),

.StartPage = chunkStartPage,

.EndPage = currentPage - 1,

.ChunkIndex = chunks.Count

})

' Create overlap with previous chunk for continuity

Dim overlap As String = If(currentChunk.Length > overlapChars,

currentChunk.ToString().Substring(currentChunk.Length - overlapChars),

currentChunk.ToString())

currentChunk.Clear()

currentChunk.Append(overlap)

chunkStartPage = currentPage - 1

End If

currentChunk.AppendLine(vbCrLf & "--- Page " & currentPage & " ---" & vbCrLf)

currentChunk.Append(pageText)

Next

If currentChunk.Length > 0 Then

chunks.Add(New DocumentChunk With {

.Text = currentChunk.ToString(),

.StartPage = chunkStartPage,

.EndPage = currentPage,

.ChunkIndex = chunks.Count

})

End If

Console.WriteLine($"Document chunked into {chunks.Count} segments")

For Each chunk In chunks

Console.WriteLine($" Chunk {chunk.ChunkIndex + 1}: Pages {chunk.StartPage}-{chunk.EndPage} ({chunk.Text.Length} chars)")

Next

' Save chunk metadata for RAG indexing

File.WriteAllText("chunks-metadata.json", JsonSerializer.Serialize(

chunks.Select(Function(c) New With {.ChunkIndex = c.ChunkIndex, .StartPage = c.StartPage, .EndPage = c.EndPage, .Length = c.Text.Length}),

New JsonSerializerOptions With {.WriteIndented = True}

))

Public Class DocumentChunk

Public Property Text As String = ""

Public Property StartPage As Integer

Public Property EndPage As Integer

Public Property ChunkIndex As Integer

End Class

Los trozos superpuestos proporcionan continuidad a través de los límites, garantizando que la IA tenga suficiente contexto incluso cuando la información relevante se extiende a través de los límites de los trozos.

Patrones RAG (Recuperación-Generación Aumentada)

La generación mejorada de recuperación representa un poderoso patrón para el análisis de documentos impulsado por IA en 2026. En lugar de alimentar a la IA con documentos enteros, los sistemas RAG recuperan primero solo las partes relevantes para una consulta determinada y, a continuación, utilizan esas partes como contexto para generar respuestas.

El flujo de trabajo de la RAG consta de tres fases principales: preparación del documento (fragmentación y creación de incrustaciones), recuperación (búsqueda de fragmentos relevantes) y generación (uso de los fragmentos recuperados como contexto para las respuestas de la IA).

El código indexa varios PDF llamando a pdf.Memorize() en cada uno y luego usa pdf.Query() para recuperar respuestas de la memoria combinada del documento.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/rag-system-implementation.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

// Retrieval-Augmented Generation (RAG) system for querying across multiple indexed documents

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Index all documents in folder

string[] documentPaths = Directory.GetFiles("documents/", "*.pdf");

Console.WriteLine($"Indexing {documentPaths.Length} documents...\n");

// Memorize each document (creates embeddings for retrieval)

foreach (string path in documentPaths)

{

var pdf = PdfDocument.FromFile(path);

await pdf.Memorize();

Console.WriteLine($"Indexed: {Path.GetFileName(path)} ({pdf.PageCount} pages)");

}

Console.WriteLine("\n=== RAG System Ready ===\n");

// Query across all indexed documents

string query = "What are the key compliance requirements for data retention?";

Console.WriteLine($"Query: {query}\n");

var searchPdf = PdfDocument.FromFile(documentPaths[0]);

string answer = await searchPdf.Query(query);

Console.WriteLine($"Answer: {answer}");

// Interactive query loop

Console.WriteLine("\n--- Enter questions (type 'exit' to quit) ---\n");

while (true)

{

Console.Write("Question: ");

string? userQuery = Console.ReadLine();

if (string.IsNullOrWhiteSpace(userQuery) || userQuery.ToLower() == "exit")

break;

string response = await searchPdf.Query(userQuery);

Console.WriteLine($"\nAnswer: {response}\n");

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.IO

' Retrieval-Augmented Generation (RAG) system for querying across multiple indexed documents

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

' Index all documents in folder

Dim documentPaths As String() = Directory.GetFiles("documents/", "*.pdf")

Console.WriteLine($"Indexing {documentPaths.Length} documents..." & vbCrLf)

' Memorize each document (creates embeddings for retrieval)

For Each path As String In documentPaths

Dim pdf = PdfDocument.FromFile(path)

Await pdf.Memorize()

Console.WriteLine($"Indexed: {Path.GetFileName(path)} ({pdf.PageCount} pages)")

Next

Console.WriteLine(vbCrLf & "=== RAG System Ready ===" & vbCrLf)

' Query across all indexed documents

Dim query As String = "What are the key compliance requirements for data retention?"

Console.WriteLine($"Query: {query}" & vbCrLf)

Dim searchPdf = PdfDocument.FromFile(documentPaths(0))

Dim answer As String = Await searchPdf.Query(query)

Console.WriteLine($"Answer: {answer}")

' Interactive query loop

Console.WriteLine(vbCrLf & "--- Enter questions (type 'exit' to quit) ---" & vbCrLf)

While True

Console.Write("Question: ")

Dim userQuery As String = Console.ReadLine()

If String.IsNullOrWhiteSpace(userQuery) OrElse userQuery.ToLower() = "exit" Then

Exit While

End If

Dim response As String = Await searchPdf.Query(userQuery)

Console.WriteLine(vbCrLf & $"Answer: {response}" & vbCrLf)

End WhileLos sistemas RAG destacan en el manejo de grandes colecciones de documentos: bases de datos de casos jurídicos, bibliotecas de documentación técnica y archivos de investigación. Al recuperar sólo las partes relevantes, se mantiene la calidad de la respuesta al tiempo que se adapta a documentos de tamaño ilimitado.

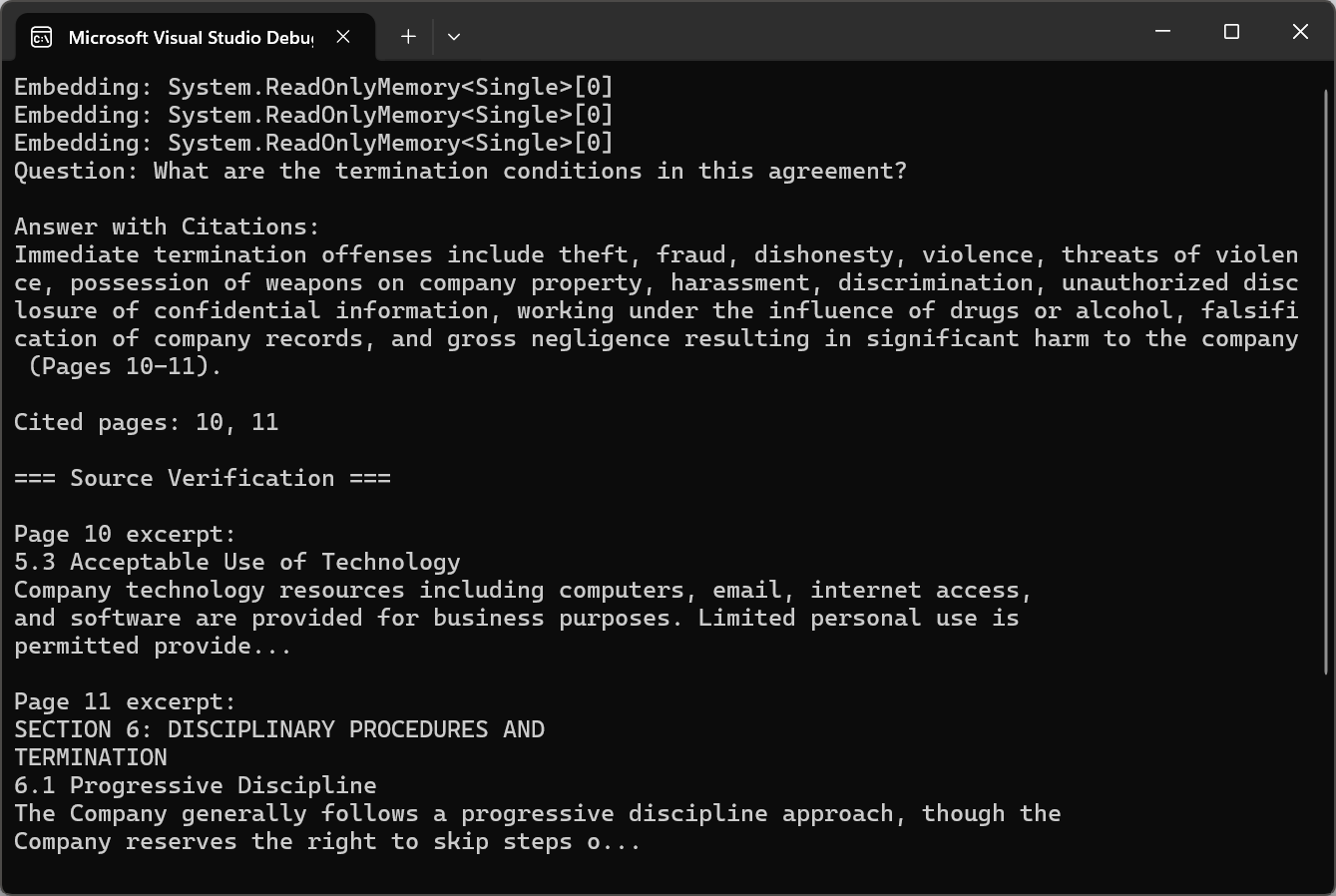

Citar fuentes de páginas PDF

Para aplicaciones profesionales, las respuestas de IA deben ser verificables. El enfoque de citación implica el mantenimiento de metadatos sobre el origen de los trozos durante la fragmentación y la recuperación. Cada fragmento almacena no solo el contenido del texto, sino también los números de página de origen, los encabezados de sección y la posición en el documento.

Entrada

El código usa pdf.Query() con instrucciones de cita, luego llama a ExtractCitedPages() con expresiones regulares para analizar referencias de página y verificar fuentes usando pdf.Pages[pageNum - 1].Text.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/answer-with-citations.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System.Text.RegularExpressions;

// Answer questions with page citations and source verification

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

var pdf = PdfDocument.FromFile("sample-legal-document.pdf");

await pdf.Memorize();

string question = "What are the termination conditions in this agreement?";

// Request citations in query

string citationQuery = $@"{question}

T: Include specific page citations in your answer using the format (Page X) or (Pages X-Y).

e information that appears in the document.";

string answerWithCitations = await pdf.Query(citationQuery);

Console.WriteLine("Question: " + question);

Console.WriteLine("\nAnswer with Citations:");

Console.WriteLine(answerWithCitations);

// Extract cited page numbers using regex

var citedPages = ExtractCitedPages(answerWithCitations);

Console.WriteLine($"\nCited pages: {string.Join(", ", citedPages)}");

// Verify citations with page excerpts

Console.WriteLine("\n=== Source Verification ===");

foreach (int pageNum in citedPages.Take(3))

{

if (pageNum <= pdf.PageCount && pageNum > 0)

{

string pageText = pdf.Pages[pageNum - 1].Text;

string excerpt = pageText.Length > 200 ? pageText.Substring(0, 200) + "..." : pageText;

Console.WriteLine($"\nPage {pageNum} excerpt:\n{excerpt}");

}

}

// Extract page numbers from citation format (Page X) or (Pages X-Y)

List<int> ExtractCitedPages(string text)

{

var pages = new HashSet<int>();

var matches = Regex.Matches(text, @"\(Pages?\s*(\d+)(?:\s*-\s*(\d+))?\)", RegexOptions.IgnoreCase);

foreach (Match match in matches)

{

int startPage = int.Parse(match.Groups[1].Value);

pages.Add(startPage);

if (match.Groups[2].Success)

{

int endPage = int.Parse(match.Groups[2].Value);

for (int p = startPage; p <= endPage; p++)

pages.Add(p);

}

}

return pages.OrderBy(p => p).ToList();

}Imports IronPdf

Imports IronPdf.AI

Imports Microsoft.SemanticKernel

Imports Microsoft.SemanticKernel.Memory

Imports Microsoft.SemanticKernel.Connectors.OpenAI

Imports System.Text.RegularExpressions

' Answer questions with page citations and source verification

' Azure OpenAI configuration

Dim azureEndpoint As String = "https://your-resource.openai.azure.com/"

Dim apiKey As String = "your-azure-api-key"

Dim chatDeployment As String = "gpt-4o"

Dim embeddingDeployment As String = "text-embedding-ada-002"

' Initialize Semantic Kernel

Dim kernel = Kernel.CreateBuilder() _

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey) _

.Build()

Dim memory = New MemoryBuilder() _

.WithMemoryStore(New VolatileMemoryStore()) _

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey) _

.Build()

IronDocumentAI.Initialize(kernel, memory)

Dim pdf = PdfDocument.FromFile("sample-legal-document.pdf")

Await pdf.Memorize()

Dim question As String = "What are the termination conditions in this agreement?"

' Request citations in query

Dim citationQuery As String = $"{question}

T: Include specific page citations in your answer using the format (Page X) or (Pages X-Y).

e information that appears in the document."

Dim answerWithCitations As String = Await pdf.Query(citationQuery)

Console.WriteLine("Question: " & question)

Console.WriteLine(vbCrLf & "Answer with Citations:")

Console.WriteLine(answerWithCitations)

' Extract cited page numbers using regex

Dim citedPages = ExtractCitedPages(answerWithCitations)

Console.WriteLine(vbCrLf & "Cited pages: " & String.Join(", ", citedPages))

' Verify citations with page excerpts

Console.WriteLine(vbCrLf & "=== Source Verification ===")

For Each pageNum As Integer In citedPages.Take(3)

If pageNum <= pdf.PageCount AndAlso pageNum > 0 Then

Dim pageText As String = pdf.Pages(pageNum - 1).Text

Dim excerpt As String = If(pageText.Length > 200, pageText.Substring(0, 200) & "...", pageText)

Console.WriteLine(vbCrLf & "Page " & pageNum & " excerpt:" & vbCrLf & excerpt)

End If

Next

' Extract page numbers from citation format (Page X) or (Pages X-Y)

Function ExtractCitedPages(ByVal text As String) As List(Of Integer)

Dim pages = New HashSet(Of Integer)()

Dim matches = Regex.Matches(text, "\((Pages?)\s*(\d+)(?:\s*-\s*(\d+))?\)", RegexOptions.IgnoreCase)

For Each match As Match In matches

Dim startPage As Integer = Integer.Parse(match.Groups(2).Value)

pages.Add(startPage)

If match.Groups(3).Success Then

Dim endPage As Integer = Integer.Parse(match.Groups(3).Value)

For p As Integer = startPage To endPage

pages.Add(p)

Next

End If

Next

Return pages.OrderBy(Function(p) p).ToList()

End FunctionSalida de consola

Las citas transforman las respuestas generadas por la IA de resultados opacos en información transparente y verificable. Los usuarios pueden revisar el material original para validar las respuestas y ganar confianza en el análisis asistido por IA.

Procesamiento de IA por lotes

Procesamiento de bibliotecas de documentos a escala

El procesamiento de documentos empresariales a menudo implica miles o millones de PDF. La base del procesamiento por lotes escalable es la paralelización. IronPDF es seguro para subprocesos, lo que permite el procesamiento simultáneo de PDF sin interferencias.

Este código utiliza SemaphoreSlim con maxConcurrency configurable para procesar archivos PDF en paralelo, llamando a pdf.Summarize() en cada uno mientras rastrea los resultados en un ConcurrentBag.

:path=/static-assets/pdf/content-code-examples/tutorials/ai-powered-pdf-processing-csharp/batch-document-processing.csusing IronPdf;

using IronPdf.AI;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Memory;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using System;

using System.Collections.Concurrent;

using System.Text;

// Process multiple documents in parallel with rate limiting

// Azure OpenAI configuration

string azureEndpoint = "https://your-resource.openai.azure.com/";

string apiKey = "your-azure-api-key";

string chatDeployment = "gpt-4o";

string embeddingDeployment = "text-embedding-ada-002";

// Initialize Semantic Kernel

var kernel = Kernel.CreateBuilder()

.AddAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.AddAzureOpenAIChatCompletion(chatDeployment, azureEndpoint, apiKey)

.Build();

var memory = new MemoryBuilder()

.WithMemoryStore(new VolatileMemoryStore())

.WithAzureOpenAITextEmbeddingGeneration(embeddingDeployment, azureEndpoint, apiKey)

.Build();

IronDocumentAI.Initialize(kernel, memory);

// Configure parallel processing with rate limiting

int maxConcurrency = 3;

string inputFolder = "documents/";

string outputFolder = "summaries/";

Directory.CreateDirectory(outputFolder);

string[] pdfFiles = Directory.GetFiles(inputFolder, "*.pdf");

Console.WriteLine($"Processing {pdfFiles.Length} documents...\n");

var results = new ConcurrentBag<ProcessingResult>();

var semaphore = new SemaphoreSlim(maxConcurrency);

var tasks = pdfFiles.Select(async filePath =>

{

await semaphore.WaitAsync();